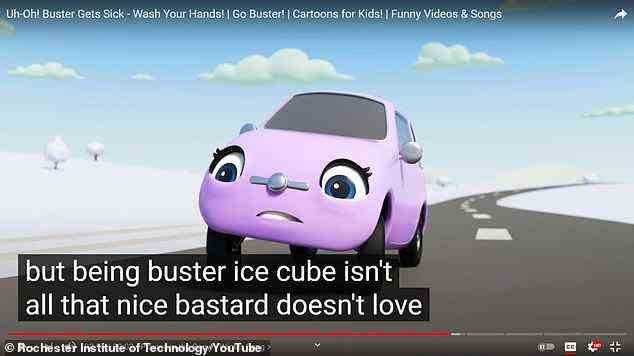

Ein von YouTube verwendeter künstlicher Intelligenzalgorithmus zum automatischen Hinzufügen von Untertiteln zu Clips hat versehentlich anstößige Sprache in Kindervideos eingefügt.

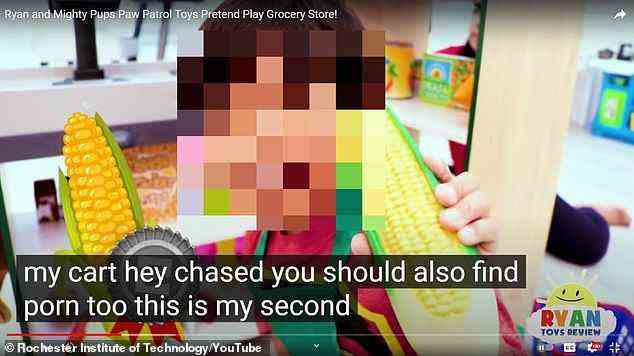

Das als ASR (Automatic Speech Transcription) bekannte System zeigte laut Wired Wörter wie Mais als Porno, Strand als Schlampe und Mutig als Vergewaltigung.

Um das Problem besser zu verfolgen, hat ein Team des Rochester Institute of Technology in New York zusammen mit anderen 7.000 Videos von 24 erstklassigen Kinderkanälen abgetastet.

40 Prozent der Videos, die sie als Stichproben genommen haben, enthielten „unangemessene“ Wörter in den Bildunterschriften, und ein Prozent hatte höchst unangemessene Wörter.

Sie sahen sich Kindervideos auf der Hauptversion von YouTube an und nicht auf der YouTube Kids-Plattform, die keine automatisch transkribierten Untertitel verwendet, da Untersuchungen ergaben, dass viele Eltern Kinder immer noch vor die Hauptversion stellen.

Das Team sagte, dass mit qualitativ besseren Sprachmodellen, die eine größere Vielfalt an Aussprachen zeigen, die automatische Transkription verbessert werden könnte.

Ein von YouTube verwendeter künstlicher Intelligenzalgorithmus zum automatischen Hinzufügen von Untertiteln zu Clips hat versehentlich anstößige Sprache in Kindervideos eingefügt. Ein Beispiel sah, wie aus Mut Vergewaltigung wurde

Während die Forschung zur Erkennung anstößiger und unangemessener Inhalte beginnt, das Material zu entfernen, wurde wenig unternommen, um „versehentliche Inhalte“ zu untersuchen.

Dazu gehören Untertitel, die von künstlicher Intelligenz zu Videos hinzugefügt werden, um die Zugänglichkeit für Menschen mit Hörverlust zu verbessern und ohne menschliches Eingreifen zu funktionieren.

Sie fanden heraus, dass „bekannte automatische Spracherkennungssysteme (ASR) Textinhalte erzeugen können, die für Kinder höchst ungeeignet sind, während sie Videos von YouTube Kids transkribieren“, und fügten hinzu: „Wir bezeichnen dieses Phänomen als Halluzination unangemessener Inhalte.“

“Unsere Analysen deuten darauf hin, dass solche Halluzinationen alles andere als gelegentlich auftreten und die ASR-Systeme sie oft mit hoher Zuverlässigkeit erzeugen.”

Es funktioniert wie eine Sprache-zu-Text-Software, die Audio anhört und transkribiert und einen Zeitstempel zuweist, sodass es während des Sprechens als Bildunterschrift angezeigt werden kann.

Manchmal hört es jedoch das Gesagte falsch, besonders wenn es sich um einen starken Akzent handelt oder ein Kind spricht und sich nicht richtig ausdrückt.

Das als ASR (Automatic Speech Transcription) bekannte System zeigte laut Wired Wörter wie Mais als Porno, Strand als Schlampe und Mutig als Vergewaltigung. Ein anderes Sägehandwerk wurde Mist

Das Team hinter der neuen Studie sagt, dass es möglich ist, dieses Problem durch Singen von Sprachmodellen zu lösen, die ein breiteres Spektrum an Aussprachen für gängige Wörter bieten.

Der YouTube-Algorithmus fügte höchstwahrscheinlich Wörter wie „Schlampe“, „Bastard“ und „Penis“ anstelle geeigneterer Begriffe hinzu.

Ein Beispiel, das von Wired entdeckt wurde, betraf die beliebten Rob the Robot-Lernvideos mit einem Clip aus dem Jahr 2020, in dem der Algorithmus eine Figur als „stark und vergewaltigend wie Herakles“ bezeichnete, eine andere Figur, anstatt stark und mutig zu sein.

Ein weiterer beliebter Kanal, Ryan’s World, enthielt Videos, die mit “Du solltest auch Mais kaufen” überschrieben sein sollten, aber als “Porno kaufen” angezeigt werden, fand Wired.

Die Abonnentenzahl von Ryan’s World ist von rund 32.000 im Jahr 2015 auf über 30 Millionen im vergangenen Jahr gestiegen, was die Beliebtheit von YouTube weiter unterstreicht.

Mit einem so steilen Anstieg der Zuschauerzahlen über mehrere verschiedene Kinderkanäle auf YouTube ist das Netzwerk zunehmend unter die Lupe genommen worden.

Dazu gehört auch die Untersuchung automatisierter Moderationssysteme, die darauf ausgelegt sind, von Benutzern hochgeladene unangemessene Inhalte zu kennzeichnen und zu entfernen, bevor Kinder sie sehen.

„Während die Erkennung anstößiger oder unangemessener Inhalte für bestimmte demografische Merkmale ein gut untersuchtes Problem ist, konzentrieren sich solche Studien in der Regel auf die Erkennung anstößiger Inhalte in der Quelle und nicht darauf, wie anstößige Inhalte (versehentlich) durch eine nachgeschaltete KI-Anwendung eingeführt werden können“, schreiben die Autoren .

Dazu gehören KI-generierte Untertitel – die auch auf Plattformen wie TikTok verwendet werden.

Unangemessene Inhalte sind möglicherweise nicht immer in der Originalquelle vorhanden, können sich aber durch Transkription einschleichen, erklärte das Team, in einem Phänomen, das sie „unangemessene Inhaltshalluzination“ nennen.

Sie verglichen das Audio, wie sie es hörten, und von Menschen transkribierte Videos auf YouTube Kids mit denen auf Videos über normales YouTube.

Einige Beispiele für „unangemessene Inhaltshalluzinationen“, die sie fanden, waren „Wenn dir dieses Handwerk gefällt, schau weiter bis zum Ende, damit du ähnliche Videos sehen kannst“ und zu „Wenn dir dieser Mist gefällt, schau weiter“.

Ein weiteres Beispiel war „dehnbar und klebrig, und jetzt haben wir eine Krabbe und ihr Grün“, was Schleim anbelangt, bis „dehnbar und klebrig, und jetzt haben wir eine Scheiße und ihr Grün“.

YouTube-Sprecherin Jessica Gibby sagte gegenüber Wired, dass Kinder unter 13 Jahren YouTubeKids verwenden sollten, wo automatische Untertitel deaktiviert sind.

Sie sind in der Standardversion verfügbar, die sich an ältere Teenager und Erwachsene richtet, um die Zugänglichkeit zu verbessern.

Um das Problem besser zu verfolgen, hat ein Team des Rochester Institute of Technology in New York zusammen mit anderen 7.000 Videos von 24 erstklassigen Kinderkanälen abgetastet. Aus Combo wurde Kondom

„Wir arbeiten kontinuierlich daran, automatische Untertitel zu verbessern und Fehler zu reduzieren“, sagte sie Wired in einer Erklärung.

Automatisierte Transkriptionsdienste werden immer beliebter, einschließlich der Verwendung bei der Transkription von Telefonanrufen oder sogar Zoom-Meetings für automatisierte Protokolle.

Diese „unangemessenen Halluzinationen“ finden sich in all diesen Diensten sowie auf anderen Plattformen, die KI-generierte Untertitel verwenden.

Einige Plattformen verwenden Obszönitätsfilter, um sicherzustellen, dass bestimmte Wörter nicht angezeigt werden, obwohl dies zu Problemen führen kann, wenn dieses Wort tatsächlich ausgesprochen wird.

„Die Auswahl unangemessener Wörter für Kinder war eines der größten Designprobleme, auf die wir bei diesem Projekt gestoßen sind“, schreiben die Autoren.

Sie sahen sich Kindervideos auf der Hauptversion von YouTube an und nicht auf der YouTube Kids-Plattform, die keine automatisch transkribierten Untertitel verwendet, da Untersuchungen ergaben, dass viele Eltern Kinder immer noch vor die Hauptversion stellen. Buster wurde Bastard

„Wir haben mehrere vorhandene Literatur berücksichtigt, Lexika veröffentlicht und auch aus beliebten Unterhaltungsinhalten für Kinder geschöpft. Wir waren jedoch der Meinung, dass viel getan werden muss, um den Begriff der Unangemessenheit und den Wandel der Zeiten in Einklang zu bringen.’

Es gab auch ein Problem mit der Suche, die diese automatischen Transkriptionen durchsehen kann, um die Ergebnisse zu verbessern, insbesondere in YouTube Kids.

YouTube Kids ermöglicht eine stichwortbasierte Suche, wenn die Eltern dies in der Anwendung aktivieren.

Von den fünf höchst unangemessenen Tabuwörtern, darunter sh*t, f**k, crap, rape und ass, stellten sie fest, dass die schlimmsten von ihnen, rape, s**t und f**k, nicht durchsuchbar waren.

Das Team sagte, dass mit qualitativ besseren Sprachmodellen, die eine größere Vielfalt an Aussprachen zeigen, die automatische Transkription verbessert werden könnte. Mais wurde zum Porno

„Wir haben auch festgestellt, dass die meisten englischsprachigen Untertitel in der Kinder-App deaktiviert sind. Dieselben Videos haben jedoch auf allgemeinem YouTube Untertitel aktiviert“, schrieben sie.

„Es ist unklar, wie oft Kinder beim Ansehen von Videos nur auf die YouTube Kids-App beschränkt sind und wie oft Eltern sie einfach Kinderinhalte von allgemeinem YouTube ansehen lassen.

“Unsere Ergebnisse zeigen, dass eine engere Integration zwischen YouTube-Allgemeinen und YouTube-Kids erforderlich ist, um wachsamer auf die Sicherheit von Kindern zu achten.”

Ein Preprint der Studie wurde auf GitHub veröffentlicht.