RoboCop erhält möglicherweise einen Neustart im 21. Jahrhundert, da ein Algorithmus gefunden wurde, der zukünftige Verbrechen eine Woche im Voraus mit einer Genauigkeit von 90 Prozent vorhersagt.

Das Tool der künstlichen Intelligenz (KI) prognostiziert Kriminalität, indem es zeitliche und geografische Muster von Gewalt- und Eigentumsdelikten lernt.

Datenwissenschaftler der University of Chicago trainierten das Computermodell mit öffentlichen Daten aus acht großen US-Städten.

Es hat sich jedoch als kontrovers erwiesen, da das Modell systemische Vorurteile bei der polizeilichen Durchsetzung und ihre komplexe Beziehung zu Kriminalität und Gesellschaft nicht berücksichtigt.

Es hat sich in der Vergangenheit gezeigt, dass ähnliche Systeme rassistische Vorurteile in der Polizeiarbeit aufrechterhalten, was möglicherweise durch dieses Modell repliziert werden könnte.

Aber die Forscher behaupten, dass ihr Modell auch verwendet werden könnte, um die Voreingenommenheit aufzudecken, und sollte nur verwendet werden, um aktuelle Polizeistrategien zu informieren.

Beispielsweise wurde festgestellt, dass sozioökonomisch benachteiligte Gebiete möglicherweise unverhältnismäßig weniger polizeiliche Aufmerksamkeit erhalten als wohlhabendere Nachbarschaften.

Ein neues Tool der künstlichen Intelligenz (KI), das von Wissenschaftlern in Chicago, USA, entwickelt wurde, prognostiziert Kriminalität, indem es zeitliche und geografische Muster von Gewalt- und Eigentumsdelikten lernt

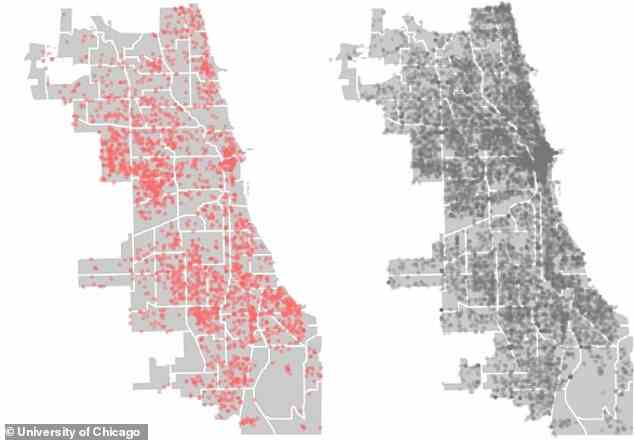

Gewaltverbrechen (links) und Eigentumsdelikte (rechts), die in Chicago innerhalb des zweiwöchigen Zeitraums zwischen dem 1. und 15. April 2017 aufgezeichnet wurden. Diese Vorfälle wurden verwendet, um das Computermodell zu trainieren

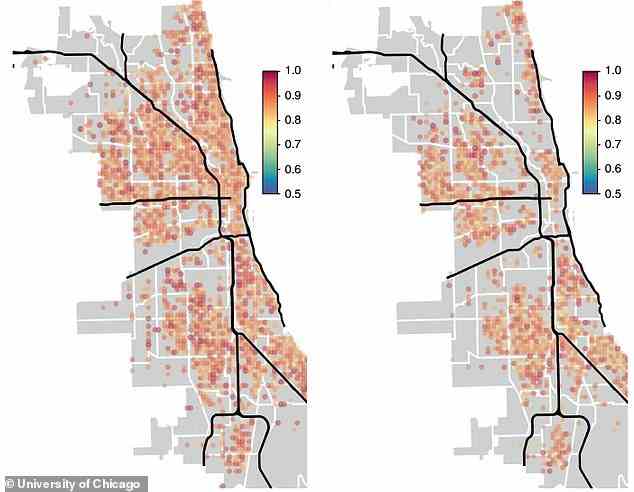

Genauigkeit der Modellvorhersagen von Gewalt- (links) und Eigentumsdelikten (rechts) in Chicago. Die Vorhersage erfolgt eine Woche im Voraus, und das Ereignis wird als erfolgreiche Vorhersage registriert, wenn ein Verbrechen innerhalb von ± einem Tag nach dem vorhergesagten Datum aufgezeichnet wird

Das Computermodell wurde mit historischen Daten von kriminellen Vorfällen aus der Stadt Chicago von 2014 bis Ende 2016 trainiert.

Es prognostizierte dann die Kriminalitätsrate für die Wochen, die auf diese Trainingsperiode folgten.

Die Vorfälle, mit denen es trainiert wurde, fielen in zwei große Kategorien von Ereignissen, die weniger anfällig für Voreingenommenheit bei der Durchsetzung sind.

Dabei handelte es sich um Gewaltverbrechen wie Tötungsdelikte, Körperverletzungen und Körperverletzungen sowie Eigentumsdelikte wie Einbrüche, Diebstähle und Kfz-Diebstähle.

Diese Vorfälle wurden auch eher der Polizei in städtischen Gebieten gemeldet, in denen es seit jeher Misstrauen und mangelnde Zusammenarbeit mit den Strafverfolgungsbehörden gibt.

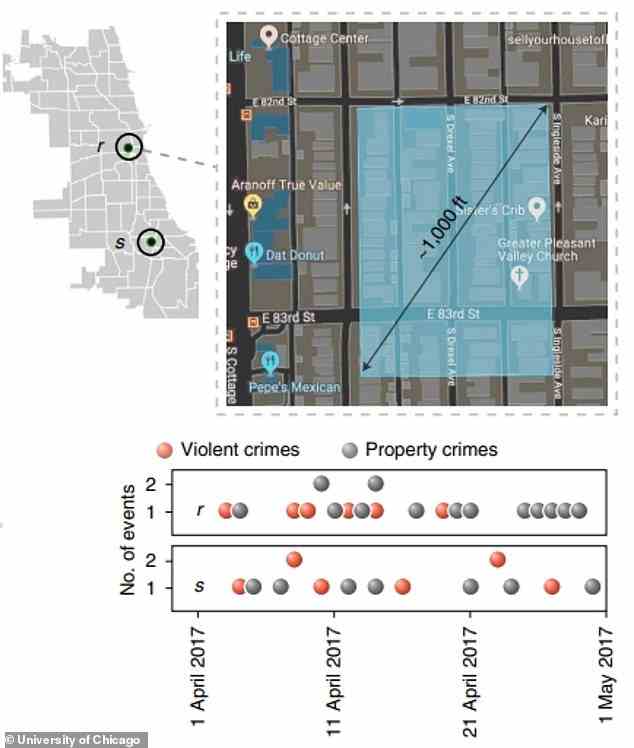

Das Modell berücksichtigt auch die zeitlichen und räumlichen Koordinaten einzelner Verbrechen und erkennt darin Muster, um zukünftige Ereignisse vorherzusagen.

Es unterteilt die Stadt in räumliche Kacheln mit einem Durchmesser von etwa 1.000 Fuß und prognostiziert die Kriminalität in diesen Gebieten.

Dies steht im Gegensatz dazu, Gebiete als „Hotspots“ der Kriminalität zu betrachten, die sich auf die umliegenden Gebiete ausbreiten, wie es frühere Studien getan haben.

Die Hotspots stützen sich oft auf traditionelle Nachbarschafts- oder politische Grenzen, die ebenfalls mit Vorurteilen behaftet sind.

Co-Autor Dr. James Evans sagte: „Räumliche Modelle ignorieren die natürliche Topologie der Stadt.

„Verkehrsnetze respektieren Straßen, Gehwege, Zug- und Buslinien, und Kommunikationsnetze respektieren Gebiete mit ähnlichem sozioökonomischem Hintergrund.

„Unser Modell ermöglicht die Entdeckung dieser Verbindungen.

“Wir demonstrieren, wie wichtig es ist, stadtspezifische Muster für die Vorhersage gemeldeter Straftaten zu entdecken, was eine neue Sicht auf die Stadtteile in der Stadt schafft, es uns ermöglicht, neue Fragen zu stellen und Polizeimaßnahmen auf neue Weise zu bewerten.”

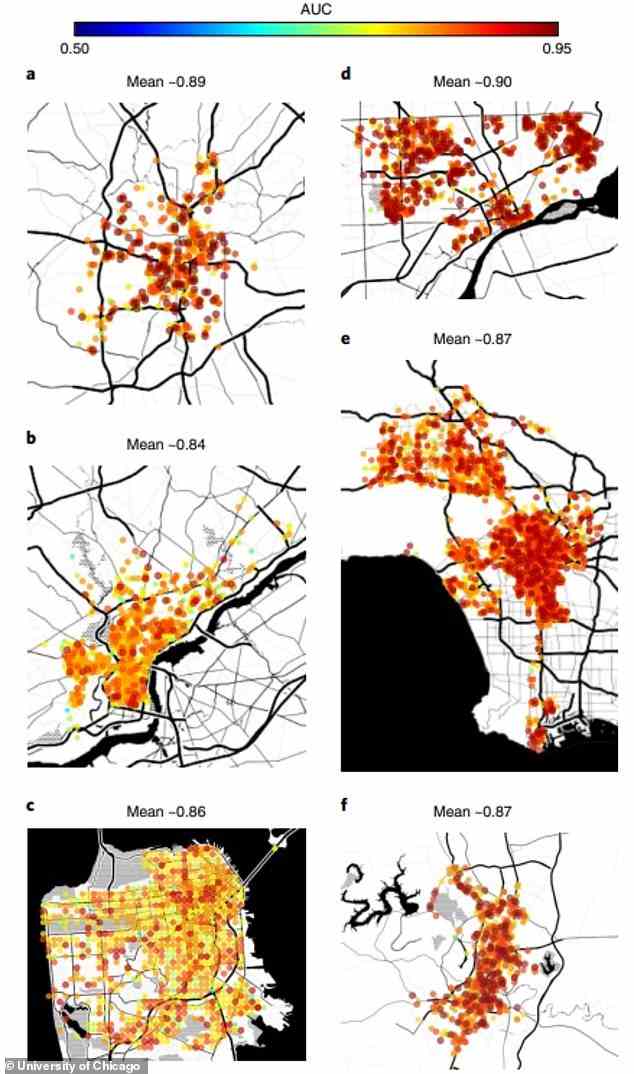

Laut Ergebnissen, die gestern in Nature Human Behaviour veröffentlicht wurden, schnitt das Modell in Daten aus sieben anderen US-Städten genauso gut ab wie in Chicago.

Dies waren Atlanta, Austin, Detroit, Los Angeles, Philadelphia, Portland und San Francisco.

Grafik, die den Modellierungsansatz des KI-Tools zeigt. Eine Stadt wird in kleine räumliche Kacheln aufgeteilt, die ungefähr 1,5-mal so groß sind wie ein durchschnittlicher Stadtblock, und das Modell berechnet Muster in den sequentiellen Ereignisströmen, die an verschiedenen Kacheln aufgezeichnet werden

Das Modell ergab auch, dass Verbrechen, die in wohlhabenderen Gegenden stattfanden, mehr Polizeiressourcen anzogen und zu mehr Verhaftungen führten als in benachteiligten Vierteln

Die Forscher verwendeten das Modell dann, um die Reaktion der Polizei auf Vorfälle in Gebieten mit unterschiedlichem sozioökonomischem Hintergrund zu untersuchen.

Sie fanden heraus, dass Verbrechen in wohlhabenderen Gegenden mehr Polizeikräfte anzogen und zu mehr Verhaftungen führten als in benachteiligten Vierteln.

Das deutet an Voreingenommenheit bei der Reaktion und Durchsetzung der Polizei.

Der leitende Autor, Dr. Ishanu Chattopadhyay, sagte: „Was wir sehen, ist, dass, wenn Sie das System belasten, mehr Ressourcen erforderlich sind, um mehr Menschen als Reaktion auf Verbrechen in einem wohlhabenden Gebiet zu verhaften, und Polizeiressourcen aus Gebieten mit niedrigerem sozioökonomischem Status abgezogen werden. ‘

Die Verwendung von Computermodellen bei der Strafverfolgung hat sich als umstritten erwiesen, da Bedenken bestehen, dass dadurch bestehende Vorurteile der Polizei noch verstärkt werden könnten.

Bereits 2016 testete die Chicago Police Department einen Algorithmus, der eine Liste von Personen erstellte, die als am stärksten gefährdet galten, entweder als Opfer oder als Täter in eine Schießerei verwickelt zu werden.

Anfangs wurden Details der Ergebnisse geheim gehalten, aber schließlich stellte sich heraus, dass 56 Prozent der schwarzen Männer in Chicago im Alter zwischen 20 und 29 auf der Liste standen.

Lawrence Sherman vom Cambridge Centre for Evidence-Based Policing sagte gegenüber New Scientist, er sei besorgt, dass das neue Modell Daten betrachtet, die anfällig für Verzerrungen sind.

Er sagte: “Es könnte eine vorsätzliche Diskriminierung durch die Polizei in bestimmten Bereichen widerspiegeln.”

Genauigkeit der Vorhersagen des Modells von Eigentums- und Gewaltverbrechen in großen US-Städten. a: Atlanta, b: Philadelphia, c: San Francisco, d: Detroit, e: Los Angeles, f: Austin. Alle diese Städte weisen eine vergleichbar hohe Vorhersageleistung auf

Dieses Tool ist jedoch nicht dazu gedacht, Polizeibeamte in Bereiche zu lenken, in denen es Verbrechen vorhersagen könnte, sondern wird laut seinen Entwicklern verwendet, um aktuelle Polizeistrategien und -richtlinien zu informieren.

Die in der Studie verwendeten Daten und Algorithmen wurden veröffentlicht, damit andere Forscher die Ergebnisse untersuchen können.

Dr. Chattopadhyay sagte: „Wir haben einen digitalen Zwilling städtischer Umgebungen geschaffen. Wenn Sie es mit Daten aus der Vergangenheit füttern, wird es Ihnen sagen, was in Zukunft passieren wird.

„Es ist nicht magisch, es gibt Einschränkungen, aber wir haben es validiert und es funktioniert wirklich gut.

„Jetzt können Sie dies als Simulationstool verwenden, um zu sehen, was passiert, wenn die Kriminalität in einem Bereich der Stadt zunimmt oder in einem anderen Bereich die Strafverfolgung verstärkt wird.

“Wenn Sie all diese verschiedenen Variablen anwenden, können Sie sehen, wie sich die Systeme als Reaktion darauf entwickeln.”