Viele kennen die beliebte Chain of Thoughts (CoT)-Methode zur Anregung generativer KI, um bessere und ausgefeiltere Antworten zu erhalten. Forscher von Google DeepMind und der Princeton University haben eine verbesserte Aufforderungsstrategie namens Tree of Thoughts (ToT) entwickelt, die die Aufforderung auf eine höhere Ergebnisebene bringt und so ausgefeiltere Argumentationsmethoden und bessere Ergebnisse ermöglicht.

Die Forscher erklären:

„Wir zeigen, wie gezielte Suche in Gedankenbäumen (Trees of Thoughts, ToT) zu besseren Ergebnissen und, was noch wichtiger ist, zu interessanten und vielversprechenden neuen Möglichkeiten zur Verwendung von Sprachmodellen zur Lösung von Problemen führt, die eine Suche oder Planung erfordern.“

Forscher vergleichen drei Arten von Aufforderungen

Die Forschungsarbeit vergleicht ToT mit drei anderen Aufforderungsstrategien.

1. Eingabe-Ausgabe-Eingabeaufforderung (IO).

Dies bedeutet im Grunde, dem Sprachmodell ein zu lösendes Problem vorzugeben und die Antwort zu erhalten.

Ein Beispiel basierend auf einer Textzusammenfassung ist:

Eingabeaufforderung: Fassen Sie den folgenden Artikel zusammen.

Ausgabeaufforderung: Zusammenfassung basierend auf dem eingegebenen Artikel

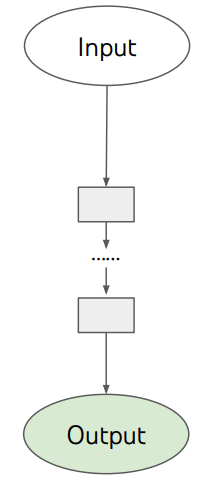

2. Gedankenkette

Bei dieser Form der Aufforderung wird ein Sprachmodell dazu angeleitet, kohärente und zusammenhängende Antworten zu generieren, indem es dazu ermutigt wird, einer logischen Abfolge von Gedanken zu folgen. Chain-of-Thought (CoT)-Prompting ist eine Möglichkeit, ein Sprachmodell durch die Zwischenschritte des Denkens zu führen, um Probleme zu lösen.

Beispiel für eine Gedankenkette:

Frage: Roger hat 5 Tennisbälle. Er kauft noch zwei Dosen Tennisbälle. Jede Dose enthält 3 Tennisbälle. Wie viele Tennisbälle hat er jetzt?

Begründung: Roger begann mit 5 Bällen. 2 Dosen mit je 3 Tennisbällen ergeben 6 Tennisbälle. 5 + 6 = 11. Die Antwort: 11Frage: Die Cafeteria hatte 23 Äpfel. Wenn sie 20 für das Mittagessen verwendet und 6 weitere gekauft hätten, wie viele Äpfel hätten sie dann?

3. Selbstkonsistenz mit CoT

Vereinfacht ausgedrückt handelt es sich hierbei um eine Aufforderungsstrategie, bei der das Sprachmodell mehrmals abgefragt wird und dann die am häufigsten gefundene Antwort ausgewählt wird.

Das Forschungspapier zur Sel-Konsistenz mit CoT vom März 2023 erklärt es:

„Es probiert zunächst einen vielfältigen Satz von Argumentationspfaden aus, anstatt nur den gierigen zu wählen, und wählt dann die konsistenteste Antwort aus, indem es die untersuchten Argumentationspfade marginalisiert.“ Selbstkonsistenz nutzt die Intuition, dass ein komplexes Argumentationsproblem typischerweise mehrere unterschiedliche Denkweisen zulässt, die zu seiner eindeutig richtigen Antwort führen.“

Duale Prozessmodelle in der menschlichen Kognition

Die Forscher lassen sich von einer Theorie darüber inspirieren, wie menschliches Entscheidungsdenken Dual-Prozess-Modelle in der menschlichen Kognition oder Dual-Prozess-Theorie nennt.

Duale Prozessmodelle in der menschlichen Kognition legen nahe, dass Menschen an zwei Arten von Entscheidungsprozessen beteiligt sind: einem, der intuitiv und schnell ist, und einem anderen, der eher bewusst und langsamer ist.

- Schnell, automatisch, unbewusst

Dieser Modus beinhaltet schnelles, automatisches und unbewusstes Denken, von dem oft gesagt wird, dass es auf Intuition basiert. - Langsam, bewusst, bewusst

Diese Art der Entscheidungsfindung ist ein langsamer, bewusster und bewusster Denkprozess, der sorgfältige Überlegungen, Analysen und schrittweise Überlegungen erfordert, bevor eine endgültige Entscheidung getroffen wird.

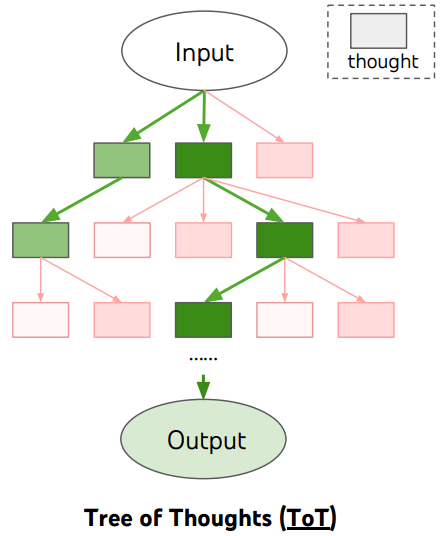

Das Tree of Thoughts (ToT)-Aufforderungsframework verwendet eine Baumstruktur für jeden Schritt des Argumentationsprozesses, die es dem Sprachmodell ermöglicht, jeden Argumentationsschritt zu bewerten und zu entscheiden, ob dieser Schritt im Argumentationsprozess realisierbar ist und zu einer Antwort führt. Wenn das Sprachmodell entscheidet, dass der Argumentationspfad nicht zu einer Antwort führt, erfordert die Aufforderungsstrategie, dass es diesen Pfad (oder Zweig) verlässt und mit einem anderen Zweig fortfährt, bis es das Endergebnis erreicht.

Gedankenbaum (ToT) versus Gedankenkette (CoT)

Der Unterschied zwischen ToT und CoT besteht darin, dass ToT über ein Baum- und Zweiggerüst für den Argumentationsprozess verfügt, während CoT einen eher linearen Weg einschlägt.

Einfach ausgedrückt weist CoT das Sprachmodell an, eine Reihe von Schritten zu befolgen, um eine Aufgabe zu erfüllen, was dem kognitiven Modell von System 1 ähnelt, das schnell und automatisch ist.

ToT ähnelt dem kognitiven Modell von System 2, das eher deliberativ ist und das Sprachmodell anweist, einer Reihe von Schritten zu folgen, aber auch einen Bewerter einzugreifen und jeden Schritt zu überprüfen und zu prüfen, ob es ein guter Schritt ist, weiterzumachen, und wenn nicht, anzuhalten und ihm zu folgen ein anderer Weg.

Illustrationen von Anreizstrategien

In der Forschungsarbeit wurden schematische Darstellungen jeder Aufforderungsstrategie veröffentlicht, mit rechteckigen Kästchen, die einen „Gedanken“ innerhalb jedes Schritts zur Erledigung der Aufgabe und zur Lösung eines Problems darstellen.

Das Folgende ist ein Screenshot, der zeigt, wie der Argumentationsprozess für ToT aussieht:

Illustration der Kette der Denkanstöße

Dies ist die schematische Darstellung für CoT, die zeigt, dass der Denkprozess eher ein gerader Weg (linear) ist:

Das Forschungspapier erklärt:

„Untersuchungen zur menschlichen Problemlösung legen nahe, dass Menschen einen kombinatorischen Problemraum durchsuchen – einen Baum, in dem die Knoten Teillösungen darstellen und die Zweige Operatoren entsprechen

die sie verändern. Welcher Zweig gewählt werden soll, wird durch Heuristiken bestimmt, die dabei helfen, sich im Problemraum zurechtzufinden und den Problemlöser zu einer Lösung zu führen.Diese Perspektive verdeutlicht zwei wesentliche Mängel bestehender Ansätze, die LMs zur Lösung allgemeiner Probleme nutzen:

1) Vor Ort erforschen sie nicht unterschiedliche Fortsetzungen innerhalb eines Denkprozesses – die Äste des Baumes.

2) Weltweit beinhalten sie keinerlei Planung, Vorausschau oder Rückverfolgung, um bei der Bewertung dieser verschiedenen Optionen zu helfen – die Art der heuristisch geführten Suche, die für die menschliche Problemlösung charakteristisch zu sein scheint.

Um diese Mängel zu beheben, führen wir Tree of Thoughts (ToT) ein, ein Paradigma, das es LMs ermöglicht, mehrere Argumentationspfade über Gedanken zu erkunden…“

Getestet mit einem mathematischen Spiel

Die Forscher testeten die Methode anhand eines Game of 24-Mathe-Spiels. „Game of 24“ ist ein mathematisches Kartenspiel, bei dem die Spieler vier Zahlen (die nur einmal verwendet werden können) aus einem Kartensatz verwenden, um sie mithilfe grundlegender Arithmetik (Addition, Subtraktion, Multiplikation und Division) zu kombinieren und so ein Ergebnis von 24 zu erhalten.

Ergebnisse und Schlussfolgerungen

Die Forscher testeten die ToT-Prompting-Strategie im Vergleich zu den drei anderen Ansätzen und stellten fest, dass sie durchweg bessere Ergebnisse lieferte.

Sie stellen jedoch auch fest, dass ToT möglicherweise nicht erforderlich ist, um Aufgaben zu erledigen, die GPT-4 bereits gut beherrscht.

Sie kommen zu dem Schluss:

„Das assoziative „System 1“ von LMs kann vorteilhaft durch ein „System 2“ erweitert werden, das auf der Suche nach einem Baum möglicher Pfade zur Lösung eines Problems basiert.

Das Tree of Thoughts-Framework bietet eine Möglichkeit, klassische Erkenntnisse zur Problemlösung in umsetzbare Methoden für moderne LMs zu übersetzen.

Gleichzeitig beheben LMs eine Schwäche dieser klassischen Methoden und bieten eine Möglichkeit, komplexe Probleme zu lösen, die nicht einfach zu formalisieren sind, beispielsweise kreative

Schreiben.Wir sehen diese Schnittstelle von LMs mit klassischen KI-Ansätzen als eine spannende Richtung.“

Lesen Sie das Original-Forschungspapier:

Gedankenbaum: Bewusste Problemlösung mit großen Sprachmodellen

Ausgewähltes Bild von Shutterstock/Asier Romero