Eine Technologie allein reicht nie aus. Damit es von Nutzen ist, muss es von anderen Elementen begleitet werden, wie zum Beispiel dem Verständnis der Bevölkerung, guten Gewohnheiten und der Akzeptanz der gemeinsamen Verantwortung für seine Folgen. Ohne einen solchen gesellschaftlichen Heiligenschein werden Technologien tendenziell ineffektiv oder unvollständig genutzt. Ein gutes Beispiel hierfür könnten die mRNA-Impfstoffe sein, die im Laufe der Zeit entwickelt wurden COVID Epidemie. Sie waren eine erstaunliche medizinische Errungenschaft – und dennoch kamen sie aufgrund des weit verbreiteten Unverständnisses nicht so gut an, wie sie hätten sein können. Es ist möglicherweise nicht einmal angemessen, eine Technologie als eine Technologie zu bezeichnen, die nicht über die Elemente verfügt, die erforderlich sind, um sie nützlich in die menschliche Welt zu bringen. Wenn wir nicht verstehen können, wie eine Technologie funktioniert, laufen wir Gefahr, dem magischen Denken zu verfallen.

Anders ausgedrückt: Wir brauchen Cartoons in unseren Köpfen darüber, wie Technologien funktionieren. Ich weiß nicht genug über Impfstoffe, um mir einen anzufertigen, aber ich habe einen Impfstoff-Cartoon, der mir einen ungefähren Eindruck davon vermittelt; Es ist gut genug, um mir zu helfen, Neuigkeiten über Impfstoffe zu verfolgen und den Entwicklungsprozess, die Risiken und die wahrscheinliche Zukunft der Technologie zu verstehen. Ich habe ähnliche Cartoons über Raketen, Finanzregulierung und Atomkraft im Kopf. Sie sind nicht perfekt, aber sie geben mir ausreichend gute Intuitionen. Sogar Experten nutzen Cartoons, um miteinander ins Gespräch zu kommen: Manchmal hilft ihnen eine vereinfachte Sichtweise, den Wald vor lauter Bäumen zu sehen.

In diesem Punkt erlebe ich mit vielen in meiner Gemeinschaft von Informatikern eine gewisse Spannung. Ich glaube, dass die Cartoons, die wir über KI ausgestrahlt haben, kontraproduktiv sind. Wir haben künstliche Intelligenz in die Welt gebracht, begleitet von Ideen, die wenig hilfreich und verwirrend sind. Das Schlimmste daran ist wahrscheinlich das Gefühl der menschlichen Veralterung und des Untergangs, das viele von uns vermitteln. Ich kann nicht verstehen, warum einige meiner Kollegen sagen, dass das, was sie tun, zum Aussterben der Menschheit führen könnte, und dennoch argumentieren, dass es sich trotzdem lohnt, es zu tun. Es ist schwer, diese Art zu reden zu verstehen, ohne sich zu fragen, ob KI zu einer neuen Art von Religion wird.

Abgesehen von der apokalyptischen Atmosphäre schaffen wir es auch nicht gut zu erklären, was das Zeug ist und wie es funktioniert. Die meisten Nicht-Techniker können eine heikle Abstraktion besser verstehen, wenn sie in konkrete Teile zerlegt wurde, über die man Geschichten erzählen kann, aber das kann in der Welt der Informatik schwer zu verkaufen sein. Wir ziehen es normalerweise vor, KI-Systeme als riesige undurchdringliche Kontinuitäten zu behandeln. Vielleicht gibt es bis zu einem gewissen Grad einen Widerstand dagegen, das, was wir tun, zu entmystifizieren, weil wir es auf mystische Weise angehen wollen. Die übliche Terminologie, beginnend mit dem Begriff „künstliche Intelligenz“, dreht sich alles um die Idee, dass wir neue Kreaturen anstelle neuer Werkzeuge erschaffen. Diese Vorstellung wird durch biologische Begriffe wie „Neuronen“ und „neuronale Netze“ sowie durch anthropomorphisierende Begriffe wie „Lernen“ oder „Training“ unterstützt, die Informatiker ständig verwenden. Ein Problem ist auch, dass es für „KI“ keine feste Definition gibt. Es ist immer möglich, spezifische Kommentare zu KI abzulehnen, weil sie keine andere mögliche Definition davon ansprechen. Die fehlende Verankerung des Begriffs deckt sich mit einer metaphysischen Sensibilität, nach der der menschliche Rahmen bald überschritten wird.

Gibt es eine Möglichkeit, KI zu erklären, ohne dass der Mensch veraltet oder ersetzt werden soll? Wenn wir anders über unsere Technologie sprechen können, wird sich vielleicht ein besserer Weg ergeben, sie in die Gesellschaft zu bringen. In „Es gibt keine KI“, einem früheren Aufsatz, den ich für dieses Magazin geschrieben habe, habe ich darüber gesprochen, die KI großer Modelle als eine Form der menschlichen Zusammenarbeit zu überdenken, statt sie als eine neue Kreatur auf der Bühne zu betrachten. In diesem Artikel möchte ich erklären, wie eine solche KI auf eine Weise funktioniert, die über den oft mysteriösen technischen Details schwebt und stattdessen betont, wie die Technologie menschliche Eingaben verändert und von ihnen abhängt. Dies ist keine Einführung in die Informatik, sondern eine Geschichte über niedliche Objekte in Zeit und Raum, die als Metaphern dafür dienen, wie wir gelernt haben, Informationen auf neue Weise zu manipulieren. Ich finde, dass die meisten Menschen den üblichen Geschichten über die Funktionsweise von KI nicht so gut folgen können wie Geschichten über andere Technologien. Ich hoffe, dass die hier vorgestellte Alternative von Nutzen sein wird.

Wir können unseren menschenzentrierten Cartoon über große KI-Modelle in vier Schritten zeichnen. Jeder Schritt ist einfach. Aber sie ergeben etwas, das man sich leicht vorstellen kann – und das man als Werkzeug zum Nachdenken verwenden kann.

I. Bäume

Der allererste Schritt, und in gewisser Weise der einfachste, ist möglicherweise auch am schwierigsten zu erklären. Wir können mit einer Frage beginnen: Wie kann man mit einem Computer herausfinden, ob auf einem Foto eine Katze oder ein Hund zu sehen ist? Das Problem ist, dass Katzen und Hunde weitgehend ähnlich aussehen. Beide haben Augen und Schnauzen, Schwänze und Pfoten, vier Beine und Fell. Für einen Computer ist es einfach, Messungen an einem Bild vorzunehmen – um festzustellen, ob es hell oder dunkel oder eher blau oder rot ist. Aber solche Messungen können eine Katze nicht von einem Hund unterscheiden. Wir können die gleiche Art von Frage auch zu anderen Beispielen stellen. Wie kann ein Programm beispielsweise analysieren, ob eine Passage wahrscheinlich von William Shakespeare stammt?

Auf technischer Ebene ist die grundlegende Antwort ein zusammengewürfeltes Gewirr von Statistiken, das wir als neuronales Netzwerk bezeichnen. Aber das erste, was man bei dieser Antwort verstehen muss, ist, dass wir es mit einer Technologie der Komplexität zu tun haben. Das neuronale Netzwerk, der grundlegendste Einstiegspunkt in die KI, ist wie eine Volkstechnologie. Wenn Forscher sagen, dass eine KI „emergente Eigenschaften“ hat – und das sagen wir oft –, dann ist das eine andere Art zu sagen, dass wir nicht wussten, was das Netzwerk tun würde, bis wir versuchten, es aufzubauen. KI ist nicht der einzige Bereich, in dem es so ist. Medizin und Wirtschaftswissenschaften sind ähnlich. In solchen Bereichen probieren wir Dinge aus, versuchen es immer wieder und finden Techniken, die besser funktionieren. Wir beginnen nicht mit einer Master-Theorie und berechnen daraus dann ein ideales Ergebnis. Dennoch können wir mit Komplexität arbeiten, auch wenn wir sie nicht perfekt vorhersagen können.

Versuchen wir, auf phantasievolle Weise darüber nachzudenken, wie man das Bild einer Katze von dem eines Hundes unterscheiden kann. Digitale Bilder bestehen aus Pixeln, und wir müssen etwas tun, um über eine bloße Liste von Pixeln hinauszukommen. Ein Ansatz besteht darin, ein Raster über das Bild zu legen, das etwas mehr als nur die Farbe misst. Beispielsweise könnten wir damit beginnen, den Grad der Farbveränderung in jedem Gitterquadrat zu messen – jetzt haben wir in jedem Quadrat eine Zahl, die die Hervorhebung scharfer Kanten in diesem Bildbereich darstellen könnte. Eine einzige Schicht solcher Messungen reicht immer noch nicht aus, um Katzen von Hunden zu unterscheiden. Aber wir können ein zweites Gitter über das erste legen und etwas am ersten Gitter messen, und dann noch eins und noch eines. Wir können einen Turm aus Ebenen aufbauen, wobei die untersten Bereiche des Bildes gemessen werden und jede weitere Ebene die Ebene darunter misst. Diese Grundidee gibt es schon seit einem halben Jahrhundert, aber erst vor kurzem haben wir die richtigen Optimierungen gefunden, damit sie gut funktioniert. Niemand weiß wirklich, ob es vielleicht noch einen besseren Weg gibt.

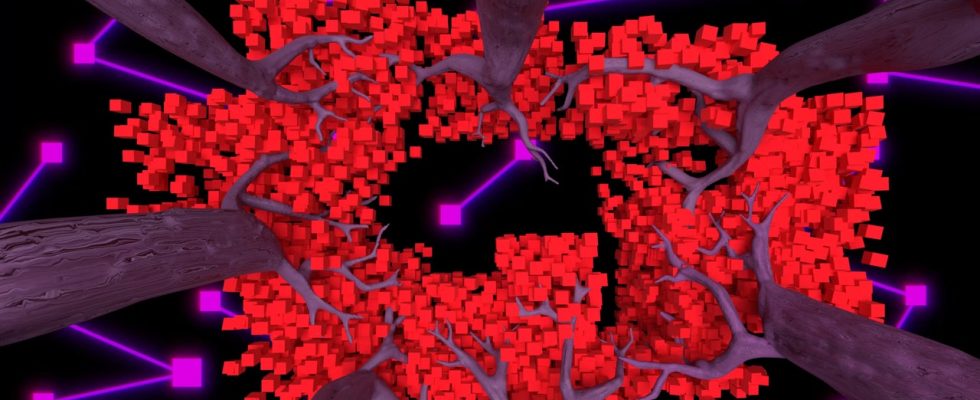

Hier werde ich unseren Cartoon fast wie eine Illustration in einem Kinderbuch gestalten. Sie können sich eine hohe Struktur dieser Gitter wie einen großen Baumstamm vorstellen, der aus dem Bild herauswächst. (Der Stamm ist wahrscheinlich rechteckig statt rund, da die meisten Bilder rechteckig sind.) Im Inneren des Baumes ist jedes kleine Quadrat auf jedem Gitter mit einer Zahl verziert. Stellen Sie sich vor, Sie klettern auf den Baum und blicken beim Aufstieg mit einem Röntgenbild hinein: Die Zahlen, die Sie am höchsten Punkt finden, hängen von den Zahlen weiter unten ab.

Leider können wir mit dem, was wir bisher haben, immer noch nicht in der Lage sein, Katzen von Hunden zu unterscheiden. Aber jetzt können wir mit dem „Training“ unseres Baumes beginnen. (Wie Sie wissen, mag ich den anthropomorphen Begriff „Training“ nicht, aber wir lassen ihn weg.) Stellen Sie sich vor, der Boden unseres Baumes wäre flach und Sie könnten Bilder darunter schieben. Nehmen Sie nun eine Sammlung von Katzen- und Hundebildern, die deutlich und korrekt mit „Katze“ und „Hund“ gekennzeichnet sind, und schieben Sie sie nacheinander unter die unterste Ebene. Die Messungen werden kaskadiert nach oben in Richtung der obersten Schicht des Baumes – wenn Sie so wollen, der Baumkronenschicht, die von Menschen in Hubschraubern gesehen werden kann. Zunächst sind die vom Canopy angezeigten Ergebnisse nicht kohärent. Aber wir können in den Baum eintauchen – sagen wir mal mit einem magischen Laser –, um die Zahlen in seinen verschiedenen Schichten anzupassen und so ein besseres Ergebnis zu erzielen. Wir können die Zahlen erhöhen, die bei der Unterscheidung zwischen Katzen und Hunden am hilfreichsten sind. Der Vorgang ist nicht einfach, da die Änderung einer Zahl auf einer Ebene zu einer Vielzahl von Änderungen auf anderen Ebenen führen kann. Wenn es uns gelingt, werden die Zahlen auf den Blättern des Blätterdachs schließlich alle Einsen sein, wenn ein Hund auf dem Foto zu sehen ist, und alle Zahlen werden zwei sein, wenn eine Katze zu sehen ist.

Jetzt haben wir erstaunlicherweise ein Werkzeug geschaffen – einen trainierten Baum –, der Katzen von Hunden unterscheidet. Informatiker nennen die auf jeder Ebene gefundenen Gitterelemente „Neuronen“, um auf eine Verbindung mit biologischen Gehirnen hinzuweisen, aber die Ähnlichkeit ist begrenzt. Während biologische Neuronen manchmal in „Schichten“ organisiert sind, beispielsweise im Kortex, ist dies nicht immer der Fall. Tatsächlich gibt es im Kortex weniger Schichten als in einem künstlichen neuronalen Netzwerk. Bei KI hat sich jedoch herausgestellt, dass das Hinzufügen vieler Ebenen die Leistung erheblich verbessert, weshalb man so oft den Begriff „tief“ verwendet, wie zum Beispiel bei „Deep Learning“ – er bedeutet viele Ebenen.