Concha sagt ein „Wettrüsten“ voraus, um die KI zu bewaffnen

Joe Concha, Mitarbeiter von Fox News, schließt sich „Fox & Friends First“ an, um über Elon Musks Warnung, dass künstliche Intelligenz Wahlen gefährden könnte, und seine Besorgnis über die sinkende Geburtenrate zu sprechen. Concha erörtert auch die Reaktion von AOC auf die Kriminalität in NYC.

Lange bevor Elon Musk und Apple-Mitbegründer Steve Wozniak einen Brief unterzeichneten, in dem davor gewarnt wurde, dass künstliche Intelligenz „tiefgreifende Risiken“ für die Menschheit birgt, hatte der britische theoretische Physiker Stephen Hawking wegen der sich schnell entwickelnden Technologie Alarm geschlagen.

„Die Entwicklung vollständiger künstlicher Intelligenz könnte das Ende der Menschheit bedeuten“, sagte Hawking 2014 in einem Interview mit der BBC.

Hawking, der mehr als 55 Jahre lang an Amyotropher Lateralsklerose (ALS) litt, starb 2018 im Alter von 76 Jahren. Obwohl er sich kritisch über KI äußerte, nutzte er auch eine sehr einfache Form der Technologie, um mit ihr zu kommunizieren seine Krankheit, die die Muskeln schwächt und Hawking dazu zwang, einen Rollstuhl zu benutzen.

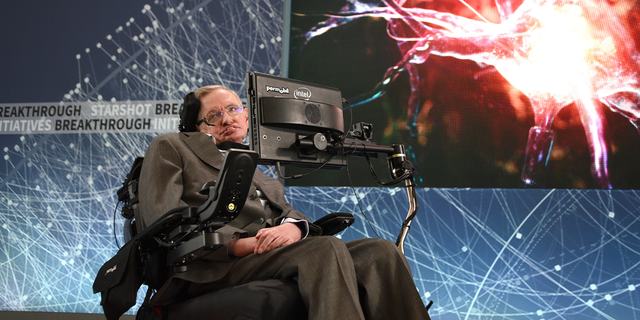

Hawking war 1985 nicht mehr in der Lage zu sprechen und verließ sich auf verschiedene Kommunikationswege, darunter ein von Intel betriebenes Spracherzeugungsgerät, das es ihm ermöglichte, Gesichtsbewegungen zu verwenden, um Wörter oder Buchstaben auszuwählen, die zu Sprache synthetisiert wurden.

STEPHEN HAWKING SAGTE IM LETZTEN BUCH „ES GIBT KEINEN GOTT“ UND DASS MENSCHEN IM WELTRAUM LEBEN WERDEN

Stephen Hawking im Jahr 2007. (Bruno Vincent / Getty Images / Datei)

Hawkings Kommentar gegenüber der BBC im Jahr 2014, dass KI „das Ende der Menschheit beschwören“ könne, war eine Antwort auf eine Frage zur möglichen Überarbeitung der Sprachtechnologie, auf die er sich stützte. Er sagte der BBC, dass sich sehr einfache Formen der KI bereits als leistungsfähig erwiesen hätten, aber die Schaffung von Systemen, die mit der menschlichen Intelligenz konkurrieren oder sie übertreffen, könne für die menschliche Rasse katastrophal sein.

„Es würde von selbst abheben und sich mit immer größerer Geschwindigkeit neu gestalten“, sagte er.

BIAS, TODESFÄLLE, AUTONOME AUTOS: EXPERTE SAGT, DASS KI-ZWISCHENFÄLLE VERDOPPELN WERDEN, WÄHREND SILICON VALLEY TECH RACE STARTET

„Menschen, die durch die langsame biologische Evolution eingeschränkt sind, könnten nicht mithalten und würden verdrängt werden“, fügte Hawking hinzu.

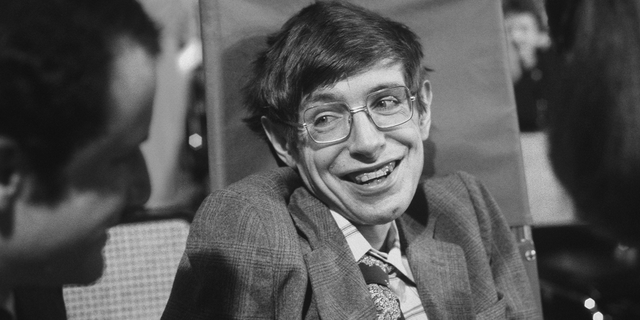

Stephen Hawking wird am 10. Oktober 1979 in Princeton, New Jersey gezeigt. (Santi Visalli/Getty Images)

Monate nach seinem Tod kam Hawkings letztes Buch auf den Markt. Sein Buch mit dem Titel „Kurze Antworten auf die großen Fragen“ lieferte den Lesern Antworten auf Fragen, die ihm häufig gestellt wurden. Das Wissenschaftsbuch hat Hawkings Argument gegen die Existenz Gottes herausgearbeitet, wie Menschen wahrscheinlich eines Tages im Weltraum leben werden, und seine Befürchtungen über Gentechnik und globale Erwärmung.

Künstliche Intelligenz nahm auch einen Spitzenplatz auf seiner Liste der „großen Fragen“ ein und argumentierte, dass Computer „wahrscheinlich innerhalb von 100 Jahren Menschen in Intelligenz überholen werden“.

„Wir könnten einer Intelligenzexplosion gegenüberstehen, die letztendlich zu Maschinen führt, deren Intelligenz unsere um mehr übersteigt als unsere die der Schnecken“, schrieb er.

Er argumentierte, dass Computer trainiert werden müssten, um sich an menschlichen Zielen auszurichten, und fügte hinzu, dass es möglicherweise „unser schlimmster Fehler aller Zeiten“ sein könnte, die mit KI verbundenen Risiken nicht ernst zu nehmen.

TECH-EXPERTE WARNT, KI KÖNNTE MENSCHLICHE KONNEKTIVITÄT BEDROHEN, ROMANTIK: „LETZTE VERSION EINER LANGEN TRADITION“

„Es ist verlockend, die Vorstellung von hochintelligenten Maschinen als reine Science-Fiction abzutun, aber das wäre ein Fehler – und möglicherweise unser schlimmster Fehler aller Zeiten.“

Hawkings Äußerungen spiegeln die Bedenken des Technologieriesen Elon Musk und des Apple-Mitbegründers Steve Wozniak aus diesem Jahr in einem im März veröffentlichten Brief wider. Die beiden Technologieführer unterzeichneten zusammen mit Tausenden anderer Experten einen Brief, in dem eine mindestens sechsmonatige Pause beim Aufbau von KI-Systemen gefordert wird, die leistungsfähiger sind als der GPT-4-Chatbot von OpenAI.

Tesla-CEO Elon Musk (Patrick Pleul / Pool / Getty Images / Datei)

„KI-Systeme mit menschlicher Wettbewerbsintelligenz können tiefgreifende Risiken für die Gesellschaft und die Menschheit darstellen, wie umfangreiche Forschungen zeigen und von führenden KI-Laboren anerkannt werden“, heißt es in dem von der gemeinnützigen Organisation Future of Life veröffentlichten Brief.

STEPHEN HAWKINGS ABSCHLIESSENDES PAPIER ENTHÜLLT

ChatGPT von OpenAI wurde mit 100 Millionen monatlich aktiven Benutzern im Januar zur am schnellsten wachsenden Benutzerbasis, da sich Menschen auf der ganzen Welt beeilten, den Chatbot zu verwenden, der menschenähnliche Gespräche auf der Grundlage von Eingabeaufforderungen simuliert. Das Labor veröffentlichte im März die neueste Iteration der Plattform, GPT-4.

ChatGPT von OpenAI wurde mit 100 Millionen monatlich aktiven Benutzern im Januar zur am schnellsten wachsenden Benutzerbasis, da Menschen auf der ganzen Welt sich beeilten, den Chatbot zu verwenden. (Eduardo Parra / Europa Press über Getty Images / Datei)

Trotz der Aufforderung, die Forschung in KI-Laboren zu unterbrechen, die an Technologien arbeiten, die GPT-4 übertreffen würden, war die Veröffentlichung des Systems ein Wendepunkt, der in der gesamten Technologiebranche nachhallte und verschiedene Unternehmen dazu katapultierte, beim Aufbau ihrer eigenen KI-Systeme zu konkurrieren.

STEPHEN HAWKING SAGT, KÜNSTLICHE INTELLIGENZ KÖNNTE DIE MENSCHHEIT „ZERSTÖREN“.

Google arbeitet daran, seine Suchmaschine zu überarbeiten und sogar eine neue zu schaffen, die auf KI basiert; Microsoft hat die „neue Suchmaschine Bing“ eingeführt, die als „KI-gestützter Kopilot für das Web“ der Benutzer bezeichnet wird; und Musk sagte, er werde ein konkurrierendes KI-System einführen, das er als „maximale Wahrheitssuche“ beschrieb.

Stephen Hawking wird am 12. April 2016 im One World Observatory in New York City gezeigt. (Bryan Bedder/Getty Images)

Hawking riet im Jahr vor seinem Tod, dass die Welt „lernen müsse, wie man sich auf die potenziellen Risiken vorbereitet und sie vermeidet“, die mit KI verbunden sind, und argumentierte, dass die Systeme „das schlimmste Ereignis in der Geschichte unserer Zivilisation sein könnten“. Er stellte jedoch fest, dass die Zukunft noch unbekannt ist und KI sich bei richtiger Ausbildung als vorteilhaft für die Menschheit erweisen könnte.

KLICKEN SIE HIER, UM DIE FOX NEWS APP ZU ERHALTEN

„Der Erfolg bei der Schaffung einer effektiven KI könnte das größte Ereignis in der Geschichte unserer Zivilisation sein. Oder das Schlimmste. Wir wissen es einfach nicht. Wir können also nicht wissen, ob uns die KI unendlich helfen oder sie ignorieren und an den Rand drängen wird. oder möglicherweise dadurch zerstört werden”, sagte Hawking während einer Rede auf der Technologiekonferenz Web Summit in Portugal im Jahr 2017.