Sind IHRE Gespräche sicher? Der ChatGPT-Ersteller bestätigt einen Fehler, der es einigen Benutzern ermöglichte, in den Chatverläufen anderer zu schnüffeln

- Sam Altman, CEO von OpenAI, bestätigte, dass ChatGPT ein „erhebliches“ Problem hatte

- Ein „kleiner Prozentsatz“ der Benutzer konnte den Chatverlauf anderer Personen einsehen

- Dies folgt auf frühere Datenschutzbedenken bezüglich der Datennutzung des Unternehmens

Der Ersteller von ChatGPT hat bestätigt, dass ein Fehler im System zugelassen wurde einige Benutzer, um in den Chatverläufen anderer Leute herumzuschnüffeln.

Sam Altman, CEO von OpenAI, bestätigte gestern Abend, dass das Unternehmen ein „erhebliches Problem“ habe, das die Privatsphäre von Gesprächen auf seiner Plattform bedroht.

Die Enthüllungen kamen, nachdem mehrere Social-Media-Nutzer ChatGPT-Gespräche online geteilt hatten, an denen sie nicht teilgenommen hatten.

Infolgedessen wurden Benutzer gestern zwischen 8:00 und 17:00 Uhr (GMT) daran gehindert, den Chatverlauf anzuzeigen.

Herr Altman sagte: „Wir hatten ein erhebliches Problem in ChatGPT aufgrund eines Fehlers in einer Open-Source-Bibliothek, für die jetzt ein Fix veröffentlicht wurde und wir gerade die Validierung abgeschlossen haben. Ein kleiner Prozentsatz der Benutzer konnte die Titel des Konversationsverlaufs anderer Benutzer sehen.’

Am Montag wurde bestätigt, dass ein „kleiner Prozentsatz“ der ChatGPT-Benutzer den Chatverlauf anderer Personen einsehen konnte

ChatGPT wurde 2015 im Silicon Valley von einer Gruppe amerikanischer Angel-Investoren gegründet, darunter der aktuelle CEO Sam Altman.

Es handelt sich um ein großes Sprachmodell, das mit einer riesigen Menge an Textdaten trainiert wurde, sodass Antworten auf eine bestimmte Eingabeaufforderung generiert werden können.

Menschen auf der ganzen Welt haben die Plattform genutzt, um menschenähnliche Gedichte, Texte und verschiedene andere schriftliche Arbeiten zu schreiben.

Ein „kleiner Prozentsatz“ der Benutzer konnte diese Woche jedoch Chat-Titel in ihrem eigenen Konversationsverlauf sehen, die nicht ihnen gehörten.

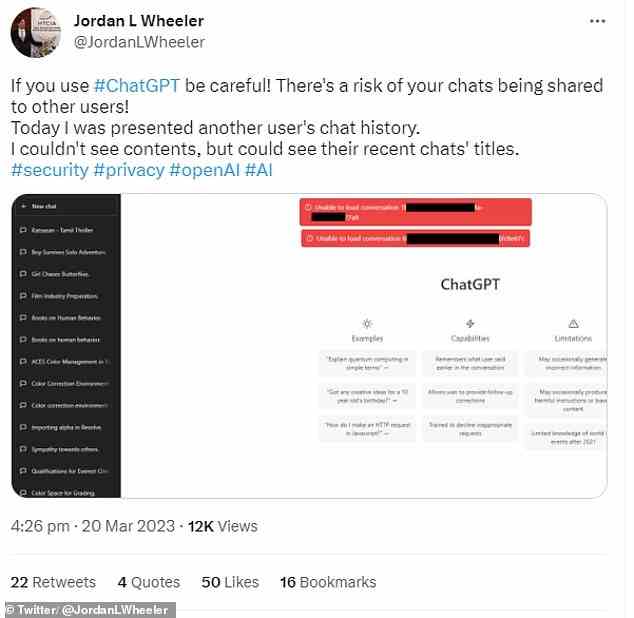

Am Montag warnte eine Person auf Twitter andere davor, „vorsichtig“ mit dem Chatbot zu sein, der ihnen die Gesprächsthemen anderer Leute gezeigt hatte.

Ein Bild ihrer Liste zeigte eine Reihe von Titeln, darunter „Mädchen jagt Schmetterlinge“, „Bücher über menschliches Verhalten“ und „Junge überlebt Solo-Abenteuer“, aber es war unklar, welche davon nicht ihre waren.

Sie sagten: „Wenn Sie #ChatGPT verwenden, seien Sie vorsichtig! Es besteht die Gefahr, dass Ihre Chats mit anderen Benutzern geteilt werden!

„Heute wurde mir der Chatverlauf eines anderen Benutzers präsentiert. Ich konnte keine Inhalte sehen, aber die Titel ihrer letzten Chats.’

Sam Altman, CEO von OpenAI, bestätigte, dass ChatGPT gestern ein „erhebliches“ Problem hatte

Benutzer wurden gestern zwischen 8:00 und 17:00 Uhr (GMT) daran gehindert, den Chatverlauf anzuzeigen

Eine Person auf Twitter warnte andere, „vorsichtig“ mit dem Chatbot zu sein, der ihnen die Gesprächsthemen anderer Leute gezeigt hatte

Während des Vorfalls fügte der Benutzer hinzu, dass er mit vielen Fehlern in Bezug auf die Netzwerkverbindung konfrontiert war, zusätzlich zu den Fehlern, dass der Verlauf nicht geladen werden konnte.

Laut BBC behauptete auch ein anderer Benutzer, er könne Gespräche sehen, die auf Mandarin geschrieben seien, und ein anderer mit dem Titel „Chinese Socialism Development“.

Im Anschluss daran ChatGPT-Funktionen wurden vorübergehend deaktiviert, da das Unternehmen an der Behebung des Problems arbeitete.

Diese Datenschutzbedenken sind jedoch nicht die ersten, die im Zusammenhang mit dem Online-Sprachmodell geäußert werden.

Letzten Monat schloss sich JP Morgan Chase Unternehmen wie Amazon und Accenture an, um die Nutzung des KI-Chatbots ChatGPT unter den rund 250.000 Mitarbeitern des Unternehmens wegen Bedenken hinsichtlich des Datenschutzes einzuschränken.

Eine der größten gemeinsamen Bedenken war, dass Daten sein könnten von den ChatGPT-Entwicklern verwendet werden, um Algorithmen zu verbessern, oder dass Ingenieure auf vertrauliche Informationen zugreifen könnten.

Die Datenschutzrichtlinie von ChatGPT besagt, dass es personenbezogene Daten im Zusammenhang mit der „Nutzung der Dienste“ verwenden kann, um „neue Programme und Dienste zu entwickeln“.

Es wird jedoch auch behauptet, dass diese personenbezogenen Daten anonymisiert oder aggregiert werden können, bevor eine Serviceanalyse stattfindet.