Die israelische Armee nutzt ein KI-System, um ihre „Tötungsliste“ mit mutmaßlichen Hamas-Terroristen zu füllen, was zum Tod von Frauen und Kindern geführt hat, heißt es in einem neuen Bericht.

Der Bericht zitierte sechs israelische Geheimdienstoffiziere, die zugaben, eine KI namens „Lavender“ eingesetzt zu haben, um bis zu 37.000 Palästinenser als mutmaßliche Militante einzustufen – und diese Menschen und ihre Häuser als akzeptable Ziele für Luftangriffe zu markieren.

Israel hat die Rolle der KI vehement bestritten und ein Armeesprecher beschrieb das System als „Hilfsinstrument, das Offiziere bei der Anklageerhebung unterstützt“.

Laut dem Bericht wurde Lavender anhand von Daten aus der jahrzehntelangen Überwachung der palästinensischen Bevölkerung durch den israelischen Geheimdienst trainiert und dabei die digitalen Fußabdrücke bekannter Militanter als Modell dafür verwendet, nach welchem Signal man im Lärm suchen sollte.

Die Geheimdienstquellen stellten fest, dass menschliche Beamte jedes von der KI ausgewählte Ziel etwa „20 Sekunden“ lang scannten, bevor sie ihr „Genehmigungssiegel“ erteilten, obwohl eine interne Studie ergeben hatte, dass Lavender AI Menschen in 10 Prozent der Fälle falsch identifizierte.

Laut einem neuen Bericht hat Israel die Identifizierung von Hamas-Terroristen, palästinensischen Zivilisten und Helfern stillschweigend einer künstlichen Intelligenz namens „Lavender“ übertragen. Aber israelische Geheimdienstquellen, so heißt es in dem Bericht, wussten, dass Lavender bei mindestens 10 Prozent seiner Militanten-IDs Fehler gemacht hatte

Sie sagten, Lavenders Entscheidungen seien dazu genutzt worden, nächtliche Luftangriffe auf Häuser zu planen, in denen mutmaßliche Kombattanten und ihre Familien schliefen, wobei Richtlinien den Tod von 15 bis 20 Unbeteiligten als „Kollateralschaden“ für jedes militante Ziel auf niedriger Ebene zuließen.

Schätzungen aus dem Gazastreifen, die durch externe, von Experten begutachtete medizinische Analysen von Johns Hopkins und anhand unabhängiger Satellitenbilder bestätigt wurden, haben die Zahl der palästinensischen Todesopfer auf über 30.000 beziffert, wobei israelische Geheimdienstquellen persönlich bestätigen, dass bei diesen von der KI ausgewählten Luftangriffen Tausende getötet wurden.

Laut Reportern der Zeitschrift +972 und Local Call, die an dem Untersuchungsbericht mitgearbeitet haben, begann die Genehmigung, Lavender effektiv die offiziellen Tötungslisten der israelischen Verteidigungsstreitkräfte (IDF) erstellen zu lassen, bereits zwei Wochen nach Beginn des Krieges im Oktober 2022.

Laut israelischen Geheimdienstquellen gab die IDF Richtlinien dazu heraus, wie viele palästinensische Zivilisten als „Kollateralschaden“ in der Umgebung getötet werden durften: bis zu 100 Unbeteiligte im Fall eines mutmaßlichen „Brigadekommandeurs“ der Hamas.

Die Software von Lavender AI entnahm Informationen der Einheit 8200, Israels jahrzehntelanger Massenüberwachung von Palästinensern, einschließlich der 2,3 Millionen Einwohner des Gazastreifens, die jeweils auf einer Skala von 1 bis 100 ihre Wahrscheinlichkeit bewerten, ein Hamas- oder PIJ-Kämpfer zu sein.

Die KI wurde auf bekannte Militante trainiert und definierte Daten, die den Daten dieser Militanten ähneln, als „Merkmale“, die zu einer hohen Bewertung beitragen.

Aktionen wie die Mitgliedschaft in einer WhatsApp-Gruppe, zu der ein nachweislich Hamas-Kämpfer gehörte, gehörten zu den „Tausenden“ Kriterien, die zur Bewertung einer Person von 1 bis 100 beitrugen.

„Um 5 Uhr morgens, [the Israeli Air Force] „Ich würde kommen und alle Häuser bombardieren, die wir markiert hatten“, sagte ein hochrangiger israelischer Geheimdienstoffizier, der nur als „B“ bezeichnet wird.

„Wir haben Tausende von Menschen getötet.“ Wir sind sie nicht einzeln durchgegangen, sondern haben alles in automatisierte Systeme gepackt, und sobald eines davon [the marked individuals] zu Hause war, wurde er sofort zur Zielscheibe. „Wir haben ihn und sein Haus bombardiert.“

Oben ein Screenshot aus einem israelischen Militärvideo, das am 29. Februar veröffentlicht wurde und zeigt, wie Palästinenser Hilfslastwagen im Norden des Gazastreifens umzingeln, bevor israelische Truppen auf die Menge feuern

Oben: Rauch eines israelischen Angriffs auf Rafah im südlichen Gazastreifen am 4. April 2024

„Es war für mich sehr überraschend, dass wir gebeten wurden, ein Haus zu bombardieren, um einen Bodensoldaten zu töten, dessen Bedeutung in den Kämpfen so gering war“, sagte eine andere Quelle.

Als es um Lavenders angebliche KI-Angriffe auf diese Palästinenser ging Diese Quelle sagte, dass sie „diesen Zielen den Spitznamen ‚Müllziele‘ gegeben haben.“

„Dennoch fand ich sie ethischer als die Ziele, die wir nur zur „Abschreckung“ bombardiert haben, Hochhäuser, die evakuiert und eingestürzt werden, nur um Zerstörung anzurichten“, sagte die ungenannte Quelle.

Eine Geheimdienstquelle bestätigte persönlich, dass sie die Bombardierung von „Hunderten“ Privathäusern dieser mutmaßlichen Junior-Mitglieder der Hamas oder des Palästinensischen Islamischen Dschihad (PIJ) auf der Grundlage der Angaben der Lavender-KI genehmigt hatte.

Die von einem Team israelischer und palästinensischer Journalisten erstellte Enthüllung ergab, dass die Lavender-KI bis zu 37.000 Palästinenser als mutmaßliche Militante einstufte und Menschen und ihre Häuser als Ziele für Luftangriffe markierte. Oben: jüngster IDF-Schaden an einem humanitären Hilfsfahrzeug

Über World Central Kitchen: humanitäre Helfer in Gaza. Die in Melbourne, Australien, geborene Lalzawmi „Zomi“ Frankcom (links) wurde am Dienstag zusammen mit mindestens sechs anderen Helfern bei einem Luftangriff auf Gaza getötet, als sie Nahrungsmittel und Hilfsgüter an Palästinenser lieferte

„Wir wussten nicht, wer der Junior ist.“ [Hamas or PIJ] Eine andere Quelle sagte, dass dies der Fall sei, weil Israel sie nicht routinemäßig verfolgte [before the war].’

„Sie wollten, dass wir angreifen.“ [the junior operatives] automatisch.’

„Das ist der Heilige Gral.“ Sobald man auf Automatik umschaltet, spielt die Zielgenerierung verrückt.“

Telefonverfolgungsdaten erwiesen sich den Geheimdienstquellen zufolge als eine notorisch unzuverlässige Metrik, die von Lavenders Algorithmus als gültig angesehen wurde.

„Im Krieg wechseln Palästinenser ständig ihr Telefon“, sagte ein Geheimdienstmitarbeiter.

„Menschen verlieren den Kontakt zu ihren Familien, geben ihr Telefon einem Freund oder einer Frau und verlieren es vielleicht.“ Es gibt keine Möglichkeit, sich zu 100 Prozent auf den automatischen Mechanismus zu verlassen, der bestimmt, welche [phone] Nummer gehört wem.’

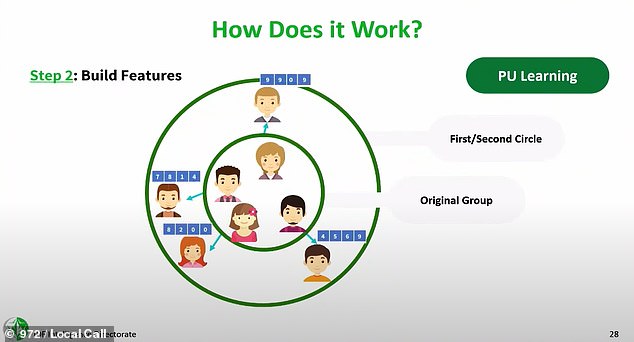

Oben sehen Sie eine Präsentationsfolie aus einem Vortrag des Kommandeurs des Datenwissenschafts- und KI-Zentrums der IDF-Einheit 8200 an der Universität Tel Aviv im Jahr 2023, in dem in einfachen Worten erklärt wird, wie Lavender AI funktioniert

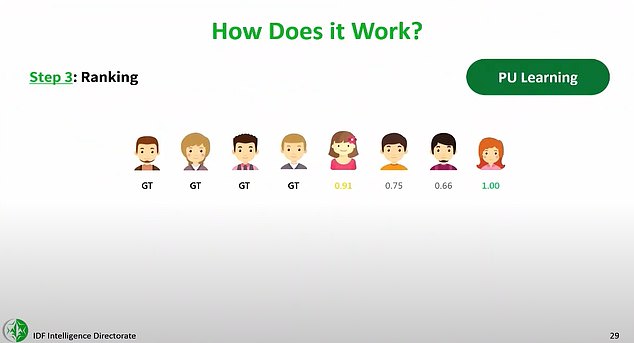

Oben eine weitere Präsentationsfolie aus dem Vortrag des Kommandanten des Datenwissenschafts- und KI-Zentrums der IDF-Einheit 8200, in der in einfachen Worten erklärt wird, wie Lavender AI funktioniert

Laut der Geheimdienstquelle namens B. hat Lavender vielen IDF-Mitgliedern geholfen, sich von den menschlichen Opfern ihrer Aktionen in Gaza zu distanzieren.

„Es gab eine unlogische Menge.“ [bombings] bei dieser Operation“, sagte B. „Das ist in meiner Erinnerung beispiellos.“

„Die Maschine hat es kaltblütig gemacht.“ Und das hat es einfacher gemacht.‘

Laut Berichten des örtlichen Gesundheitsministeriums (MoH) sind die Todesfälle in Gaza aufgrund von IDF-Bombenangriffen und anderen militärischen Reaktionen auf über 30.000 gestiegen. Diese wurden inzwischen von medizinischen Forschern am Johns Hopkins, unter anderem für einen Artikel in The Lancet, eingehend analysiert und bestätigt Andere.

Die Forscher von Johns Hopkins verglichen diese Todesmeldungen mit öffentlichen Informationen über die Bombenangriffe, Volkszählungsdaten und -analysen des UN-Bevölkerungsfonds sowie Satellitenbildern von NASA Open Street Maps, um die Plausibilität der Todeszahlen zu überprüfen.

„Das derzeit vom palästinensischen Gesundheitsministerium verwendete System zur Meldung von Todesfällen wurde im Jahr 2021, zwei Jahre vor dem aktuellen Krieg, bewertet und es wurde festgestellt, dass die Sterblichkeit um 13 Prozent zu niedrig gemeldet wurde“, sagten die Forscher.

Die London School of Hygiene and Tropical Medicine hat anhand ihrer eigenen Messwerte auch die Zahl der Todesopfer durch zusätzliche Satellitenbilder der Bombenanschläge der IDF bestätigt.

Die London School hat nun mit Johns Hopkins zusammengearbeitet, um die künftigen Todesfälle bis August für drei Szenarien abzuschätzen: 11.580 zusätzliche Todesfälle in einem Waffenstillstandsszenario aufgrund von Krankheit und Unterernährung; 66.720 zusätzliche Todesfälle für ein Status-Quo-Szenario; und 85.750 zusätzliche Todesfälle, wenn es zu einer Eskalation der Feindseligkeiten kommt.

Im vergangenen Oktober startete Israel seine Militärkampagne in Gaza, einer dicht besiedelten Küstenregion, die als Teil des jahrzehntelangen Territorialkonflikts Israels mit palästinensischen Bewohnern entstanden ist, die seit Generationen und historisch mit der Region verbunden sind.

Bei einem Terroranschlag der Hamas am 7. Oktober 2023 auf das Nova Music Festival in der Nähe der Siedlung Re’im kamen schätzungsweise 1.200 Israelis und Geiseln ums Leben.

Der daraus resultierende verheerende Konflikt hat zu einem Aufruf des UN-Sicherheitsrates zu einem sofortigen Waffenstillstand, zu Kriegsverbrecherverfahren vor dem Internationalen Gerichtshof in Den Haag und zu weit verbreiteten Forderungen nach einer schnelleren und friedlicheren Lösung geführt.