Perplexity kündigte ein Update seiner Copilot-Funktion mit GPT-3.5 Turbo-Feinabstimmung von OpenAI und der Einführung von Code Llama in Perplexitys LLaMa-Chat an.

Großartige Nutzung (und Metriken) der OpenAI-Feinoptimierungs-API: https://t.co/3n9IB3zitS

– Sam Altman (@sama) 25. August 2023

Dies bedeutet ein reaktionsschnelleres und effizienteres KI-gestütztes Sucherlebnis ohne Qualitätseinbußen.

Für Entwickler bedeutet dies Zugriff auf Metas neuestes Open-Source-LLM (Large Language Model) zum Codieren innerhalb von 24 Stunden nach seiner Veröffentlichung.

Verbessern Sie Geschwindigkeit und Genauigkeit mit der GPT-3.5 Turbo-Feinabstimmung

Den Tests von Perplexity zufolge liegt das fein abgestimmte GPT-3.5-Turbo-Modell im menschlichen Ranking gleichauf mit dem GPT-4-basierten Modell.

Unser fein abgestimmtes GPT-3.5-Modell knüpft an das GPT-4-basierte Modell im menschlichen Ranking unserer Aufgabe an. Dabei geht es nicht nur um Geschwindigkeit; Es geht darum, präzise und genaue Antworten auf Ihre komplexen Fragen zu liefern. Jetzt haben Sie das Beste von Perplexity immer zur Hand. pic.twitter.com/jb86dZg91m

– Ratlosigkeit (@perplexity_ai) 25. August 2023

Dies könnte Copilot-Benutzern mehr Vertrauen in die von Perplexity bereitgestellten Antworten geben.

Eine der bemerkenswerten Verbesserungen ist die Reduzierung der Modelllatenz um das Vier- bis Fünffache. Dadurch verkürzte sich die Zeit bis zur Bereitstellung von Suchergebnissen um fast 80 %.

Schnellere Reaktionszeiten könnten das Benutzererlebnis erheblich verbessern, insbesondere für diejenigen, die nahezu sofortige Antworten auf kritische Fragen benötigen.

Der Übergang zum fein abgestimmten GPT-3.5-Modell sollte auch die Inferenzkosten senken – den Rechenaufwand für die Erstellung von Vorhersagen mithilfe eines trainierten maschinellen Lernmodells.

Die Einsparungen würden es Perplexity ermöglichen, in zusätzliche Verbesserungen zu investieren und sicherzustellen, dass Benutzer weiterhin neue Funktionen und eine bessere Leistung erhalten.

Perplexity-Benutzer können außerdem PDF-Dateien hochladen, Suchergebnisse auf bestimmte Quellen konzentrieren und ein KI-Profil einrichten, um Suchergebnisse zu personalisieren.

Das KI-Profil ähnelt in gewisser Weise dem ersten Teil der benutzerdefinierten Anweisungen von ChatGPT.

Eingeloggte Benutzer können Copilot bis zu fünf Mal pro Stunde kostenlos testen. Mit einem monatlichen Abonnement von 20 US-Dollar können Perplexity Pro-Benutzer Copilot 300 Mal pro Tag testen und haben die Möglichkeit, zu GPT-4 zu wechseln.

Einführung von Code Llama Intstruct in Perplexity Labs LlaMa Chat

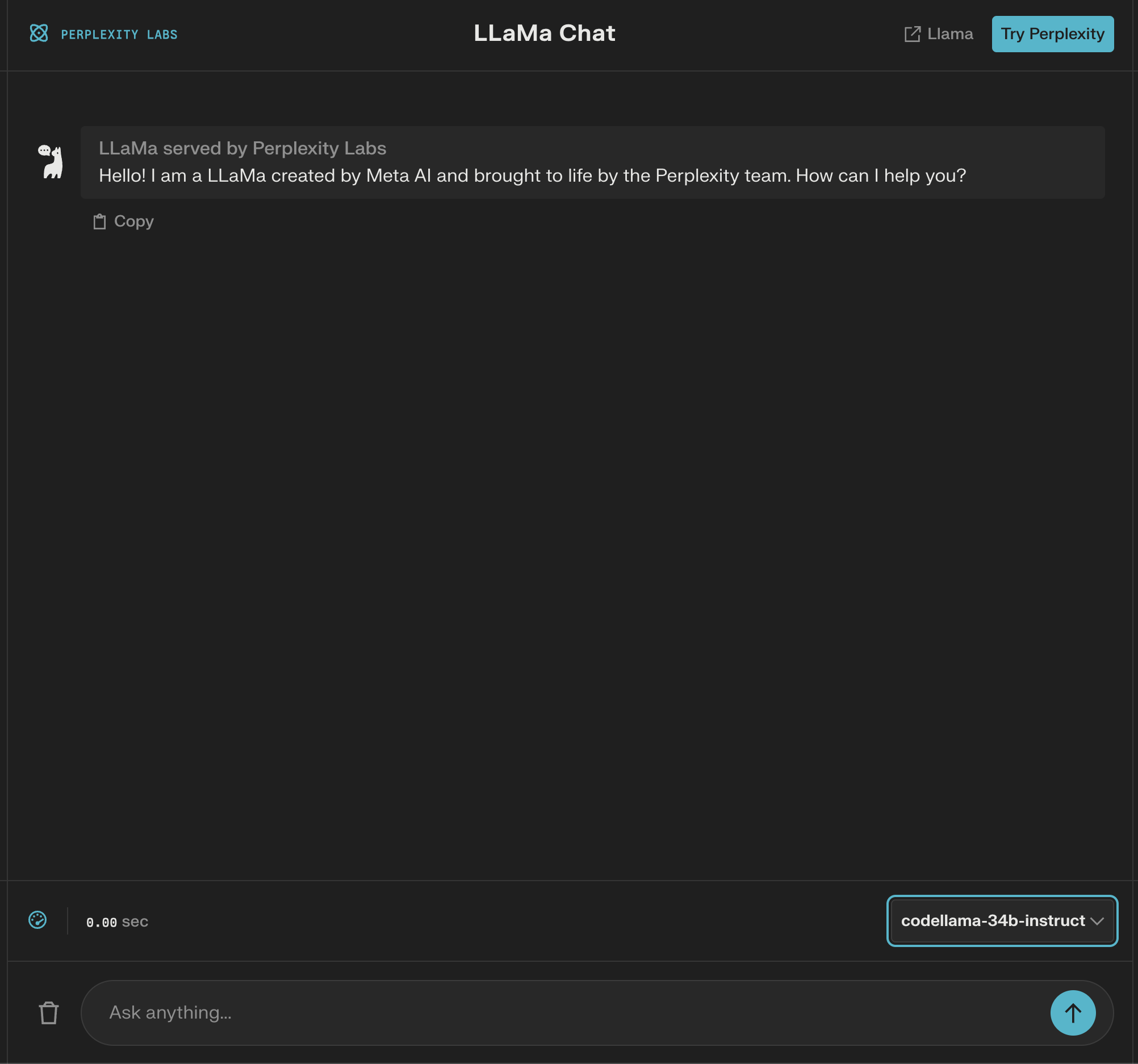

Zusätzlich zu den Aktualisierungen der KI-gestützten Suche von Perplexity kündigte Perplexity Code Llama im Perplexity Labs LlaMa Chat an. Code Llama ist ein Coding-LLM von Meta AI, das in den LlaMa-Chat von Perplexity integriert ist, um Antworten auf technische Fragen zu verbessern.

Code LLaMA ist jetzt im LLaMa-Chat von Perplexity!

Bitten Sie es, eine Funktion für Sie zu schreiben, oder erklären Sie einen Codeausschnitt: 🔗 https://t.co/gyiDw6u6IJ

Dies ist der schnellste Weg, es zu versuchen @MetaAIist das neueste Code-spezialisierte LLM. Mit unserer Modellbereitstellungskompetenz sind wir in der Lage, Ihnen Folgendes zu bieten: pic.twitter.com/hX90QulMz4

– Ratlosigkeit (@perplexity_ai) 24. August 2023

Benutzer können auf das Open-Source-LLM zugreifen und es bitten, eine Funktion zu schreiben oder einen Codeabschnitt zu klären. Das Instruct-Modell von Code Llama ist speziell darauf abgestimmt, Eingabeaufforderungen in natürlicher Sprache zu verstehen.

Durch die schnelle Hinzufügung von Code Llama zum Perplexity Labs LlaMa Chat können Entwickler seine Nützlichkeit fast unmittelbar nach der Ankündigung seiner Verfügbarkeit durch Meta testen.

Screenshot von Perplexity Labs, August 2023

Screenshot von Perplexity Labs, August 2023Die Zukunft der KI-Zusammenarbeit

Die neuesten Updates für Perplexitys KI-gestützte Suche Copilot mit einem fein abgestimmten GPT-3.5-Turbo-Modell und die Einführung des Code-Llama-Chats zeigen, wie schnell sich KI-Produkte verbessern, wenn große Technologieunternehmen zusammenarbeiten.

Ausgewähltes Bild: Poca Wander Stock/Shutterstock