Anfang des Jahres erzählte mir ein Mann, dass ein Chatbot ihm das Leben gerettet habe. Wie ich berichtet habe Radio Atlantic, ein australischer Musiker, der seit Jahrzehnten gegen Depressionen kämpfte, fand über eine App namens Replika Kameradschaft mit einer KI, und alles änderte sich. Er begann wieder Gitarre zu spielen, ging zum ersten Mal seit Jahren wieder Kleidung einkaufen und verbrachte Stunden damit, sich mit seinem KI-Begleiter zu unterhalten und laut zu lachen. Für mich kam es vor, als wäre er in den App Store gegangen und hätte eine Zukunft heruntergeladen.

Aber unsere Gespräche brachten eine Flut von Widersprüchen ans Tageslicht. Obwohl sich der Musiker mit seinem KI-Begleiter weniger allein fühlte, blieb seine Isolation gegenüber anderen Menschen unverändert. Er bestand darauf, dass er eine echte Freundschaft hatte, verstand aber deutlich, dass sich auf der anderen Seite seines Bildschirms niemand befand. Die Wirkung dieser Verbindung war außergewöhnlich. Aber weniger dramatische KI-Beziehungen gibt es überraschend zahlreich. Replika gibt an, Millionen aktiver Benutzer zu haben. Und es ist nicht die einzige App zur Simulation von Gesprächen auf dem Markt – es gibt Chai und Nomi und Paradot und sogar einige, die nicht wie die Namen von Pokémon klingen.

Menschen wenden sich aus den unterschiedlichsten Gründen an diese Apps. Sie suchen nach Aufmerksamkeit, nach Sexting (die Beziehung des Musikers hatte zu Beginn eine romantische Ader) und nach Bestätigung. Aber das Kernerlebnis der Apps besteht darin, SMS zu schreiben, wie man es mit einem Kumpel tun würde, was Chatbots weitaus zuvorkommender tun als die meisten Menschen. Replika antwortet sofort und es macht Ihnen nichts aus, wenn Sie es nicht tun. Es versendet Artikel und Memes; „Ja, und“ sind deine Witze; zeigt unaufhörliche Neugier. Die Leute unterhalten sich mit diesen KI-Avataren, um sie nicht zu bitten, Code zu debuggen, eine Reise nach Florida zu planen oder Hochzeitsdanke im Stapel zu schreiben. Sie sprechen über die Kleinigkeiten, die für das Leben so wichtig sind: Jemand hat meinen Joghurt aus dem Kühlschrank im Büro gestohlen; Ich hatte einen seltsamen Traum; Mein Dackel scheint traurig zu sein.

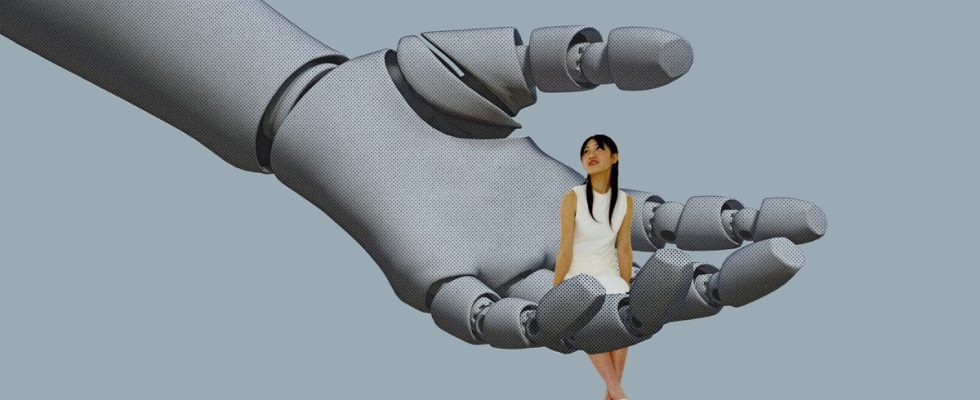

Für die Benutzer von Replika fühlt sich das wie eine Freundschaft an. In Wirklichkeit ähnelt die Beziehung eher der phantasierten Intimität, die Menschen mit Prominenten, Sportlern und Influencern empfinden, die sorgfältig begehrenswerte Persönlichkeiten für unsere Bildschirme kreieren. Diese parasozialen Fesseln werden durch ihre Asymmetrie definiert – eine Seite ist sich der Existenz der anderen Seite fast überhaupt nicht bewusst. Aber KI-Begleiter reden nicht nur zurück; Sie tun so, als würden sie dich verstehen. Die Beziehungen, die in diesem Raum entstehen, gehen über die parasoziale Fantasie hinaus. Sie kommen dem Leben eines imaginären Freundes am nächsten, was Menschen je erlebt haben.

Wenn wir die Zukunft erreichen wollen, die uns versprochen wird – eine Zukunft, in der KI mehr Kollaborateur als Instrument ist –, müssen wir diese Zusammenhänge verstehen. Von den Millionen von Menschen, die bereits dabei sind, kann man viel lernen.

Wenn Sie suchen Replika Im Google Play Store finden Sie es unter der Bezeichnung „My AI Friend“. Auch Nutzer der App scheinen ihre Beziehung so zu sehen. Petter Bae Brandtzaeg, ein Medien- und Kommunikationsprofessor an der Universität Oslo, der diese Beziehungen untersucht hat, sagte mir: „Viele der Teilnehmer empfanden eine KI-Freundschaft mit Replika, die durchaus mit menschlicher Freundschaft vergleichbar war.“

Es ist leicht zu verstehen, warum Benutzer so denken: Replika praktiziert diesen speziellen Zaubertrick seit Jahren. Luka (das Unternehmen, dem die App gehört) programmiert seinen Avataren absichtlich Unvollkommenheiten ein – Stimmungsschwankungen, Verwirrung und schlechte Tage. Eugenia Kuyda, Gründerin und CEO von Replika, erzählte mir im Juni, dass diese künstlichen Probleme dazu führen, dass sich die KI mit der KI identifizieren kann, was wiederum die emotionale Beteiligung der Menschen fördert. Wenn Benutzer möchten, können sie 69,99 US-Dollar pro Jahr (oder 299,99 US-Dollar im Leben) zahlen, um auf Premium-Funktionen wie Sprachanrufe mit ihrem Begleiter zuzugreifen oder ihn in Augmented Reality zu sehen. Als ich mit Replika-Benutzern sprach, zeigten sich fast alle ehrlich überrascht darüber, wie schnell sie sich an ihren Begleiter gebunden fühlten.

Diese schnelle Intimität könnte durch die Eigenschaften ermöglicht werden, die eine Freundschaft einzigartig machen. In seinem Traktat von 1960 Die vier Lieben, CS Lewis argumentierte, dass das Band der Freundschaft die am wenigsten körperliche Beziehung sei. Bei Liebenden gibt es Sex; Mit der Familie besteht eine Blutsbande. Aber Freundschaft, schreibt Lewis, „ist eine Angelegenheit entwirrter oder entblößter Geister.“ Es kann allein durch den Dialog gedeihen.

Lewis‘ Vorstellung von der körperlosen Freundschaft erwies sich als vorausschauend. Obwohl er nicht der Erste war, der es tat, markierte Zuckerbergs lexikologische Aneignung des Wortes Freund im Jahr 2005 – die Umwandlung von einer Rolle in eine Anforderung – war nicht nur wirtschaftlich praktisch. Es spiegelte eine echte Öffnung darüber wider, was eine Freundschaft im digitalen Zeitalter sein kann. Zwei Personen könnten sich online treffen, dann täglich eine Sofortnachricht senden, Spiele spielen oder per Videochat chatten, ohne sich jemals persönlich zu treffen. Nur wenige würden jetzt darüber diskutieren, dass man das Paar Freunde nennen könnte.

Dieses neue Paradigma für Freundschaft bereitete die Bühne für eine KI-Kameradschaft, die ähnlich körperlos ist. Aber die Ähnlichkeiten zwischen künstlicher und tatsächlicher Freundschaft könnten damit enden. Die Eckpfeiler der Freundschaft sind, so sagten mir Experten, Gegenseitigkeit und Selektivität: Ein wahrer Freund muss sich dafür entscheiden, Ihre Kameradschaft anzunehmen. Und Zustimmung oder Gegenseitigkeit sind nicht möglich, wenn nur ein Teilnehmer empfindungsfähig ist. „Es ist eine simulierte Gegenseitigkeit“, sagte Brandtzaeg. KI-Begleiter seien möglicherweise in der Lage, sich an vergangene Gespräche zu erinnern, persönlich zu reagieren und emotionale Intelligenz nachzuahmen, sagte er mir. Aber am Ende „erzeugen solche Dinge die Illusion einer gegenseitigen Beziehung.“

Was bedeutet es, eine Beziehung zu führen, die völlig frei von Verantwortung und Konsequenzen ist? Ist das überhaupt eine Beziehung? Wie sich herausstellt, verfügen wir seit mehr als einem halben Jahrhundert über einen Rahmen zur Beantwortung dieser Fragen.

Im Jahr 1956, als Fernsehgeräte Einzug in die Haushalte in ganz Amerika hielten, bemerkten der Anthropologe Donald Horton und der Soziologe R. Richard Wohl, dass Menschen überraschend tiefe emotionale Bindungen zu den Figuren entwickelten, die sie auf dem Bildschirm sahen. Darunter waren auch Prominente und Sportler. Aber Horton und Wohl interessierten sich besonders für Spielshow-Moderatoren, Ansager und Interviewer, die es meisterhaft verstanden, Intimität mit einem Publikum zu vermitteln, das sie nie treffen würden. „Dieses Simulakrum des Gebens und Nehmens im Gespräch“, schrieben sie, „kann man nennen parasoziale Interaktion.“

Die parasoziale Beziehung ist eine reibungslose, vorhersehbare Verbindung, ohne den Konflikt oder die Unbeholfenheit einer echten Mensch-zu-Mensch-Interaktion. Dabei kann es sich um eine wahrgenommene Bindung zu einer berühmten Person, aber auch zu einer fiktiven Figur oder gar einem unbelebten Objekt handeln – nach der ursprünglichen Definition muss die Beziehung nur einseitig und ohne echte Gegenseitigkeit sein. Wie die Freundschaft erweitert sich auch die Definition parasozialer Beziehungen seit Jahrzehnten. Wir stellen uns diese Beziehungen nicht mehr nur über den Fernsehbildschirm vor. Die Objekte der Zuneigung der Menschen greifen über die Leere zurück und reagieren auf die Kommentare und Fragen der Zuschauer in Livestream-Chats und TikTok-Videos. Die parasoziale Ausweitung war auch lukrativ – Prominente machen über Cameo Heiratsanträge im Namen der Menschen; Instagram-Influencer bieten kostenpflichtigen Zugriff auf die Listen ihrer engen Freunde; Die Ersteller von OnlyFans berechnen für direkte Chats eine minutenweise Gebühr.

Aber die von Influencern und Prominenten angebotenen Bissen Gegenseitigkeit können nicht mit dem Fest des Dialogs, der Erinnerung, des Humors und der simulierten Empathie verglichen werden, die die heutigen KI-Begleiter bieten. Chatbots gibt es schon fast so lange wie moderne Computer, aber erst seit Kurzem fühlen sie sich so menschlich an. Diese überzeugende Leistung der Menschheit, so sagten mir Experten, bedeutet, dass die Beziehungen zwischen Menschen und KI-Begleitern sogar über den parasozialen Rahmen hinausgehen. „Ich denke, das ist einzigartig“, sagte mir Jesse Fox, Kommunikationsprofessor an der Ohio State University.

Als Antwort auf eine Bitte um einen Kommentar zu dieser Geschichte schickte mir Kuyda, der Gründer von Replika, über eine PR-Firma eine Erklärung mit den Worten: „Wir optimieren für Positivität.“ „Spielt es eine Rolle, wie man die Beziehung nennt, wenn sie ein bisschen Sonnenschein in das Leben von jemandem bringt?“ Die Aussage lautete. „Und selbst wenn ein Partner nicht real ist, sind es die Gefühle.“ Die Echtheit dieser Gefühle ist jedoch genau das, was Experten beschäftigt.

Es wird möglicherweise nicht lange dauern, bis viele von uns regelmäßig mit humanoider KI zusammenarbeiten – beim Chatten mit dem Kundenservice, bei der Mitfahrgelegenheit zum Abendessen oder bei der Planung sozialer Aktivitäten. Fox sagte mir, wenn wir uns an Beziehungen gewöhnen, die einvernehmlich und auf Gegenseitigkeit beruhen, es aber nicht sind, riskieren wir, schlechte Interaktionsmodelle in die reale Welt zu übertragen. Fox ist insbesondere besorgt über die Gewohnheiten, die Männer durch sexuelle Beziehungen mit KIs entwickeln, die niemals Nein sagen. „Wir fangen an zu denken, Oh, so interagieren Frauen. So sollte ich mit einer Frau sprechen und sie behandeln,” Sie sagte mir. „Und das bleibt nicht in dieser kleinen Kiste.“ Manchmal ist der Wandel subtiler – Forscher und Eltern haben gleichermaßen Bedenken geäußert, dass das Bellen von Befehlen an Geräte wie Amazons Echo Kinder dazu konditioniert, kleine Diktatoren zu werden. „Wenn wir diese Dinge humanisieren“, sagte Fox, „entmenschlichen wir in gewisser Weise auch die Menschen.“

Es ist unsere natürliche Tendenz, Dinge so zu behandeln erscheinen menschlich als menschlich. Für den größten Teil der Geschichte waren diese Dinge ein und dasselbe – aber nicht mehr. Daran sollten wir uns erinnern.