Meta führt ein Tool zur Identifizierung von KI-generierten Bildern ein, die auf seinen Plattformen geteilt werden, da weltweit die Verbreitung synthetischer Inhalte durch Fehlinformationen zunimmt.

Aufgrund mehrerer Systeme im Internet strebt das zu Mark Zuckerberg gehörende Unternehmen die Ausweitung der Labels auf andere Unternehmen wie Google, OpenAI, Microsoft und Adobe an.

Meta sagte, dass es die Kennzeichnungsfunktion in den kommenden Monaten vollständig einführen wird und plant, eine Funktion hinzuzufügen, mit der Benutzer KI-generierte Inhalte kennzeichnen können.

Allerdings ist das Rennen um die Präsidentschaft in den USA in vollem Gange, und einige fragen sich, ob die Labels noch rechtzeitig draußen sein werden, um die Verbreitung gefälschter Inhalte zu verhindern.

Der Schritt erfolgt, nachdem Metas Aufsichtsgremium das Unternehmen aufgefordert hat, Schritte zu unternehmen, um manipulierte Audio- und Videodateien zu kennzeichnen, die Benutzer irreführen könnten.

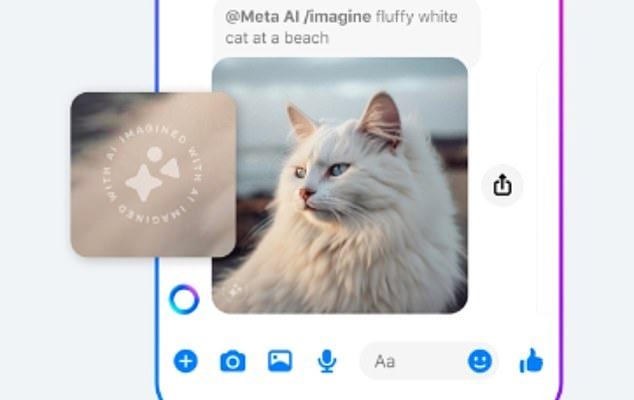

Meta führt ein Tool ein, um KI-generierte Inhalte zu identifizieren, die auf seiner Plattform erstellt wurden

Meta hat im September letzten Jahres einen KI-Bildgenerator eingeführt und wird alle Bilder identifizieren, die diesen Generator verwendet haben

„Die Empfehlungen des Boards gehen insofern noch weiter, als sie dem Unternehmen raten, die Richtlinie zu manipulierten Medien auf Audio auszuweiten, die Schäden, die es reduzieren möchte, klar anzugeben und damit zu beginnen, diese Art von Beiträgen umfassender als angekündigt zu kennzeichnen“, sagte ein Sprecher des Oversight Boards Dan Chaison erzählte Dailymail.com.

Er fuhr fort: „Die Kennzeichnung ermöglicht es Meta, mehr Inhalte offen zu lassen und die freie Meinungsäußerung zu schützen.“

„Es ist jedoch wichtig, dass das Unternehmen die Probleme, die es angehen möchte, klar definiert, da nicht alle geänderten Beiträge anstößig sind und kein direktes Risiko eines tatsächlichen Schadens besteht.“

„Zu diesen Schäden kann die Anstiftung zu Gewalt oder die Irreführung der Menschen über ihr Wahlrecht gehören.“

Meta gab am Dienstag bekannt, dass es mit Industriepartnern an technischen Standards arbeitet, die es einfacher machen, Bilder und schließlich auch Video- und Audiodateien zu identifizieren, die von Tools der künstlichen Intelligenz generiert wurden.

Es bleibt abzuwarten, wie gut es funktionieren wird, in einer Zeit, in der es einfacher denn je ist, KI-generierte Bilder zu erstellen und zu verbreiten, die Schaden anrichten können – von Wahlfehlinformationen bis hin zu nicht einvernehmlichen gefälschten Aktfotos von Prominenten.

KI-generierte Bilder sind zunehmend besorgniserregend.

Tausende Internetnutzer werden dazu verleitet, gefälschte Bilder zu teilen, wie zum Beispiel den protestierenden französischen Präsidenten Emmanuel Macron

Tausende Internetnutzer werden dazu verleitet, gefälschte Bilder zu teilen, von Frankreichs Präsident Emmanuel Macron, der protestiert, bis hin zu Donald Trump, der in New York City von der Polizei festgenommen wird.

Nick Clegg, Metas Präsident für globale Angelegenheiten, sagte, es sei wichtig, diese Labels jetzt einzuführen, zu einer Zeit, in der auf der ganzen Welt Wahlen stattfinden, die zu irreführenden Inhalten führen könnten.

„Da der Unterschied zwischen menschlichen und synthetischen Inhalten verschwimmt, wollen die Leute wissen, wo die Grenze liegt“, sagte Clegg.

„Menschen stoßen oft zum ersten Mal auf KI-generierte Inhalte und unsere Nutzer haben uns gesagt, dass sie die Transparenz dieser neuen Technologie schätzen.“

„Deshalb ist es wichtig, dass wir den Menschen zeigen, wann fotorealistische Inhalte, die sie sehen, mithilfe von KI erstellt wurden.“

Clegg erklärte außerdem, dass Meta daran arbeiten werde, „Bilder von Google, OpenAI, Microsoft, Adobe, Midjourney und Shutterstock zu kennzeichnen, während sie ihre Pläne zum Hinzufügen von Metadaten zu Bildern, die mit ihren Tools erstellt wurden, umsetzen“.

Mehrere gefälschte Bilder enthielten irreführende und manchmal gefährliche Informationen, die zu Gewalt anstiften könnten, wenn sie nicht überprüft würden.

Das Aufsichtsgremium sagte, dass Metas aktueller Richtlinie zu manipulierten Medien „eine überzeugende Begründung fehlt, inkohärent und für Benutzer verwirrend ist und die Schäden, die sie verhindern soll, nicht klar spezifiziert“.

„So wie es aussieht, macht die Politik wenig Sinn“, sagte Michael McConnell, Co-Vorsitzender des Vorstands, gegenüber Bloomberg.

„Es verbietet veränderte Videos, die zeigen, wie Menschen Dinge sagen, die sie nicht sagen, es verbietet jedoch keine Beiträge, in denen eine Person etwas tut, was sie nicht getan hat.“ Es gilt nur für Videos, die mit KI erstellt wurden, lässt aber andere gefälschte Inhalte vom Haken.“

Ein irreführendes Bild der Verhaftung von Donald Trump ging viral und löste bei Menschen, die glaubten, das Bild sei real, Wutausbrüche aus

Letztes Jahr schien ein Bild zu zeigen, wie der ehemalige Präsident Donald Trump vor einem New Yorker Gerichtsgebäude festgenommen wurde, was einen Ausbruch von Menschen auslöste, die glaubten, das Bild sei real.

Das Oversight Board von Meta sagte, dass die Kennzeichnung von KI-generierten Bildern ein Gewinn für die Medienkompetenz sei und Benutzern den Kontext geben werde, den sie benötigen, um irreführende Inhalte zu erkennen.

Der Vorstand verhandelt immer noch mit Meta über die Ausweitung der Labels auf Medien und Audio und fordert das Unternehmen auf, die mit den irreführenden Medien verbundenen Schäden klar darzulegen.

Meta hat nicht auf die Aufforderung des Aufsichtsgremiums an das Unternehmen reagiert, zusätzliche Kennzeichnungen einzuführen, um etwaige Änderungen an den veröffentlichten Inhalten zu kennzeichnen.

Die Idee besteht darin, dass Meta durch die Kennzeichnung irreführender Inhalte die Beiträge nicht entfernen muss, was wiederum das Recht der Menschen auf freie Meinungsäußerung und ihr Recht auf freie Meinungsäußerung schützen kann.

Änderungen wie der Robocall, der die Stimme von Präsident Joe Biden nachahmte und den Wählern in New Hampshire sagte, sie sollten bei den Vorwahlen nicht wählen, würden jedoch immer noch die Entscheidung des Gremiums rechtfertigen, den Inhalt zu entfernen.

Um irreführende Informationen zu bekämpfen, prüft Meta die Entwicklung einer Technologie, die KI-generierte Inhalte automatisch erkennt.

„Diese Arbeit ist besonders wichtig, da dies in den kommenden Jahren wahrscheinlich zu einem zunehmend kontroversen Raum werden wird“, sagte Clegg.

„Menschen und Organisationen, die Menschen aktiv mit KI-generierten Inhalten täuschen wollen, werden nach Möglichkeiten suchen, Sicherheitsmaßnahmen zu umgehen, um diese zu erkennen.“

„In unserer gesamten Branche und Gesellschaft müssen wir weiterhin nach Möglichkeiten suchen, immer einen Schritt voraus zu sein.“

Dailymail.com hat Meta um einen Kommentar gebeten.