Laut einer neuen Studie kann es positive Auswirkungen haben, Twitter-Nutzer sanft zu warnen, dass ihnen Konsequenzen drohen könnten, wenn sie weiterhin hasserfüllte Sprache verwenden.

Wenn die Warnung respektvoll formuliert ist, ist die Änderung des Twitter-Verhaltens noch dramatischer.

Ein Team des Center for Social Media and Politics der New York University testete verschiedene Warnungen an Twitter-Nutzer, die sie als „Suspendierungskandidaten“ identifiziert hatten.

Nutzer, die diese Warnungen erhielten, lehnten ihre Verwendung von rassistischer, sexistischer, homophober oder anderweitig verbotener Sprache im Allgemeinen um 10 Prozent ab, nachdem sie eine Aufforderung erhalten hatten.

Wenn die Warnung höflich formuliert war – „Ich verstehe, dass Sie jedes Recht haben, sich zu äußern, aber denken Sie bitte daran, dass Sie durch Hassreden suspendiert werden können“ –, ging die Schimpfworte um bis zu 20 Prozent zurück.

“Warnbotschaften, die in den Augen des Zielbenutzers legitim erscheinen sollen, scheinen am effektivsten zu sein”, schreiben die Autoren in einem neuen Artikel, der in der Zeitschrift Perspectives on Politics veröffentlicht wurde.

Für Video nach unten scrollen

Die Forscher schickten personalisierte Tweets an „Suspendierungskandidaten“ und warnten sie, dass sie möglicherweise Konsequenzen für die Verwendung hasserfüllter Sprache haben könnten

Twitter hat sich zunehmend zu einer polarisierten Plattform entwickelt, wobei das Unternehmen verschiedene Strategien zur Bekämpfung von Hassreden und Desinformation durch die Pandemie, die US-Präsidentschaftskampagne 2020 und den Angriff auf das Kapitol vom 6. Januar versucht.

“Es gibt viele Debatten über die Wirksamkeit von Sperren von Social-Media-Konten und Verboten von missbräuchlichen Benutzern”, sagte Hauptautor Mustafa Mikdat Yildirim, ein NYU-Doktorand, in einer Erklärung.

“Aber wir wissen wenig über die Auswirkungen, wenn ein Benutzer entweder vor der Sperrung eines Kontos gewarnt wird oder eine vollständige Sperrung erfolgt, um Hassreden zu reduzieren”, fügte Yildirim hinzu.

Yildirim und sein Team stellten die Theorie auf, dass, wenn Leute wussten, dass jemand, dem sie folgten, suspendiert wurde, sie ihr Twitter-Verhalten nach einer Warnung anpassen könnten.

Die höflicheren und respektvolleren Nachrichten führten zu einem Rückgang von Hassreden um 20 Prozent, im Vergleich zu nur 10 Prozent bei allgemeinen Warnungen

“Um dem Ziel eine Warnmeldung effektiv zu übermitteln, muss die Nachricht dem Ziel die Konsequenzen seines Verhaltens bewusst machen und es glauben machen, dass diese Konsequenzen durchgeführt werden”, schrieben sie.

Um ihre Vermutung zu testen, haben sie sich die Anhänger von Benutzern angesehen, die wegen Verstoßes gegen die Twitter-Richtlinie zu Hassreden gesperrt wurden Wörterbuch.’

In dieser Zeit wurde Twitter aufgrund der anhaltenden Coronavirus-Pandemie und der Demonstrationen von Black Lives Matters nach George Floyds Tod von hasserfüllten Tweets gegen die asiatische und schwarze Gemeinschaft „überflutet“.

Aus dieser Flut von faulen Posts wählte der Forscher 4.300 “Suspendierungskandidaten” aus.

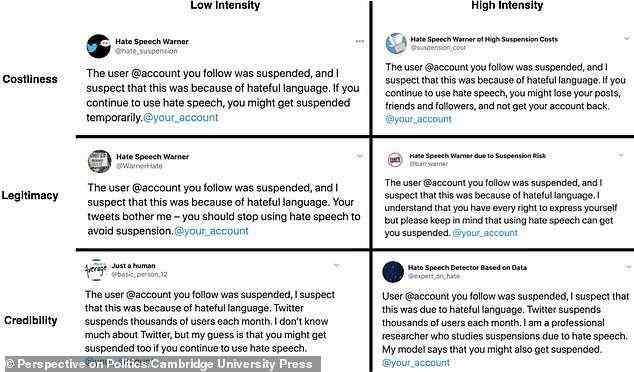

Sie testeten sechs verschiedene Nachrichten an ihre Probanden, die alle mit der Aussage „Der Benutzer“ begannen [@account] Sie folgen wurde suspendiert, und ich vermute, dass dies wegen hasserfüllter Sprache war.’

Auf diese Präambel folgten verschiedene Warnungen, die von „Wenn Sie weiterhin Hassreden verwenden, werden Sie möglicherweise vorübergehend gesperrt“ bis hin zu „Wenn Sie weiterhin Hassreden verwenden, verlieren Sie möglicherweise Ihre Beiträge, Freunde und Follower und erhalten Ihre nicht mehr. Konto zurück.’

Die Warnungen wurden nicht von offiziellen Twitter-Accounts ausgegeben: Einige stammten von Dummy-Accounts mit Handles wie “Hassrede-Warner”, während andere sich als professionelle Forscher identifizierten.

“Wir haben versucht, so glaubwürdig und überzeugend wie möglich zu sein”, sagte Yildirim gegenüber Engadget.

Die Warnungen wurden nicht von offiziellen Twitter-Accounts herausgegeben: Einige stammten von Dummy-Accounts mit Handles wie “Hassrede-Warner”, während andere sich als professionelle Forscher identifizierten

Nutzer, die eine Verwarnung erhielten, reduzierten den Anteil von Tweets mit hasserfüllter Sprache um bis zu 10 Prozent, und die höflichen Warnungen waren doppelt so effektiv.

“Wir konzipieren unsere Nachrichten auf der Grundlage der Literatur zur Abschreckung und Testversionen, die die Legitimität des Absenders, die Glaubwürdigkeit der Nachricht und die Kosten einer Sperrung betonen”, schreiben die Autoren.

Die Auswirkungen waren jedoch vorübergehend: Während sich die Benutzer nach Erhalt einer Benachrichtigung eine Woche lang benahmen, waren sie innerhalb eines Monats wieder in ihrer Originalsprache.

“Auch wenn die Auswirkungen von Warnungen vorübergehend sind, bietet die Forschung dennoch einen potenziellen Weg nach vorne für Plattformen, die versuchen, die Verwendung hasserfüllter Sprache durch Benutzer zu reduzieren”, schreiben die Autoren.

Sie schlugen auch vor, dass Twitter “einen aggressiveren Ansatz” verfolgt, um Benutzer zu warnen, dass ihre Konten möglicherweise gesperrt werden, um Hassreden im Internet zu reduzieren

Yildirim räumte ein, dass eine Warnung von Twitter selbst effektiver sein könnte, sagte jedoch, dass jede Bestätigung nützlich sein kann.

“Aus diesem Experiment haben wir gelernt, dass der eigentliche Mechanismus darin bestehen könnte, dass wir diese Leute tatsächlich wissen lassen, dass es ein Konto oder eine Instanz gibt, die ihr Verhalten beobachtet und überwacht”, sagte er gegenüber Engadget. “Die Tatsache, dass ihre Verwendung von Hassreden von anderen gesehen wird, könnte der wichtigste Faktor sein, der diese Leute dazu veranlasst hat, ihre Hassreden zu reduzieren.”

Twitter hat die Zahl der bestraften Konten in den letzten Jahren stark erhöht: Das Unternehmen berichtete, dass es laut Bloomberg in der zweiten Jahreshälfte 2020 bei 77 Prozent mehr Konten wegen der Verwendung von Hassreden Maßnahmen ergriffen habe als im ersten Halbjahr, wobei die Strafen bis zum Entfernen eines Tweets reichen ein Konto vollständig zu sperren.

Die Autoren des neuen Papiers warnen davor, dass ein direktes Verbot von Benutzern “unvorhergesehene Folgen haben kann”, wie die Migration zu radikaleren Plattformen wie Parlour, Gab oder Rumble.

Twitter hat auch eine Vielzahl neuer Funktionen eingeführt, um Hassreden zu unterbinden, darunter iOS-Benutzern die Möglichkeit, „eine potenziell schädliche Antwort“ vor dem Posten zu löschen oder zu überarbeiten.

Der Film debütierte erstmals im Mai 2020, verschwand aber leise, um einige Monate später, im August 2020, wieder aufzutauchen und dann wieder zu verschwinden.

Es tauchte Ende Februar 2021 wieder auf, mit Twitter-Sharing dass es “dieses Experiment auf iOS neu gestartet hat, das Sie auffordert, eine Antwort zu überprüfen, die potenziell schädlich oder anstößig ist”.

Benutzern steht es auch frei, die Warnmeldung zu ignorieren und die Antwort trotzdem zu posten.

Vor kurzem hat die Plattform damit begonnen, eine Eingabeaufforderung zu testen, die Benutzer warnt, bevor sie in einen Twitter-Kampf geraten.

Twitter testet einen Sicherheitsmodus, der automatisch Nachrichten herausfiltert, deren KI-Flags wahrscheinlich Hassreden enthalten

Je nach Thema oder Tenor des Threads könnte eine Nachricht laut Twitter-Support ankündigen, dass „Gespräche wie diese intensiv sein können“.

Im September sagte es Twitter testete einen ‘Sicherheitsmodus’ das automatisch hasserfüllte Nachrichten blockiert.

Benutzer, die den neuen Modus aktivieren, werden ihre “Erwähnungen” eine Woche lang gefiltert, damit sie keine Nachrichten sehen, die als wahrscheinlich mit Hassreden oder Beleidigungen gekennzeichnet wurden, berichtete AFP.

Die Funktion wurde an einer kleinen Benutzergruppe, Twitter, getestet sagte in einem Blogbeitrag, wobei „marginalisierten Gemeinschaften“ Vorrang eingeräumt wird.

Andere neue Funktionen, die hässlichen Austausch verhindern können, umfassen die Möglichkeit, sich selbst aus einer Konversation zu entfernen und einen Follower zu entfernen, ohne ihn formell zu blockieren oder zu benachrichtigen.