Forscher haben US-Beamte dafür kritisiert, dass sie keine strengeren KI-Regeln eingeführt hatten, bevor Popstar Taylor Swift Opfer von Deepfakes wurde.

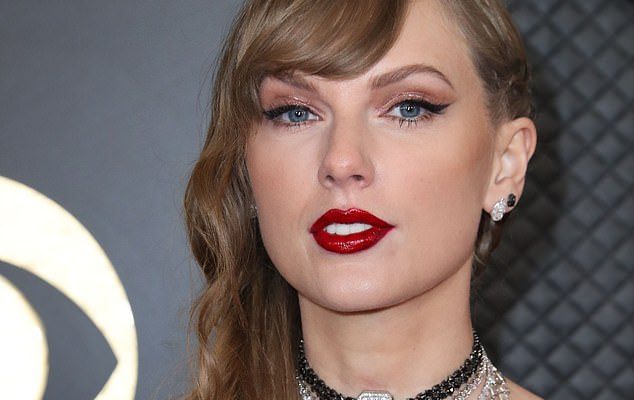

Bilder zeigen die viermal Grammy-Gewinnerin bei einer Reihe von sexuellen Handlungen, während er Erinnerungsstücke des Kansas City Chiefs trug und im Stadion – und der Pornografie-Anteil – angesehen wurde 47 Millionen Mal online, bevor es entfernt wurde.

Ein Professor an der juristischen Fakultät der George Washington University sagte, wenn die entsprechende Gesetzgebung „vor Jahren verabschiedet worden wäre“, hätten Swift und andere keinen solchen Missbrauch erlebt.

„Zu diesem Zeitpunkt sind wir zu klein und zu spät“, sagte Mary Anne Franks.

„Es wird nicht nur das 14-jährige Mädchen oder Taylor Swift sein. Es werden Politiker sein. Es werden Weltführer sein. Es werden Wahlen sein.‘

Nicht einvernehmliche, sexuell eindeutige Deepfake-Bilder von Taylor Swift kursierten in den sozialen Medien und wurden 47 Millionen Mal angesehen, bevor sie entfernt wurden

Eine Gruppe von Mädchen im Teenageralter wurde an einer High School in New Jersey Opfer von Deepfake-Bildern, als ihre männlichen Klassenkameraden begannen, Nacktfotos von ihnen in Gruppenchats zu teilen.

Berichten zufolge sprach einer der Jungen im Gruppenchat am 20. Oktober mit einem seiner Klassenkameraden darüber, der es der Schulleitung vorbrachte.

„Meine Tochter schrieb mir: ‚Mama, es werden Nacktfotos von mir verteilt.“ Das ist es. „Auf dem Weg zum Büro des Direktors“, sagte eine Mutter gegenüber CBS News.

Sie fügte hinzu, dass ihre 14-jährige Tochter „anfing zu weinen, und dann ging sie durch die Flure und sah andere Mädchen der Westfield High School weinen.“

Doch erst als Deepfake-Fotos von Taylor Swift viral gingen, drängten die Gesetzgeber zum Handeln.

X hat das Konto, das ursprünglich grafische Deepfake-Bilder von Swift gepostet hatte, wegen Verstoßes gegen die Plattformrichtlinien geschlossen, aber es war zu spät – sie wurden bereits 24.000 Mal erneut gepostet.

Ein Bericht von 404 Media enthüllte, dass die Bilder möglicherweise von einer Gruppe auf Telegram stammten, nachdem Benutzer Berichten zufolge Witze darüber gemacht hatten, wie die Bilder von Swift viral gingen.

X sagte Seine Teams ergriffen „angemessene Maßnahmen“ gegen die Konten, die die Deepfakes gepostet hatten, und gaben an, die Situation zu überwachen und die Bilder zu entfernen.

Letzte Woche führten US-Senatoren den Disrupt Explicit Forged Images and Non-Consensual Edits Act von 2024 (DEFIANCE Act) ein, kurz nachdem Swift Opfer der Technologie wurde.

„Obwohl die Bilder möglicherweise gefälscht sind, ist der Schaden für die Opfer durch die Verbreitung sexuell expliziter ‚Deepfakes‘ sehr real“, sagte Dick Durbin (D-Illinois), Mehrheitsführer im Senat, letzte Woche.

„Die Opfer haben ihren Arbeitsplatz verloren und leiden möglicherweise unter anhaltenden Depressionen oder Angstzuständen.“

„Durch die Einführung dieses Gesetzes geben wir den Opfern die Macht zurück, gehen hart gegen die Verbreitung von ‚Deepfake‘-Bildern vor und machen die Verantwortlichen für die Bilder zur Rechenschaft.“

Der Gesetzgeber schlug den Defiance Act vor, der es Menschen ermöglichen würde, diejenigen zu verklagen, die Deepfake-Inhalte von ihnen erstellt haben

Politiker haben letztes Jahr das Gesetz zur Verhinderung von Deepfakes von intimen Bildern vorgelegt, das die Weitergabe nicht einvernehmlicher Deepfake-Pornografie illegal machen würde, aber es wurde noch nicht verabschiedet.

„Wenn vor Jahren Gesetze verabschiedet worden wären, in denen Befürworter gesagt hätten, dass dies mit dieser Art von Technologie zwangsläufig passieren wird, wären wir möglicherweise nicht in dieser Lage“, sagt Franks, Professor an der George Washington University Law School und Präsident der Cyber Civil Rights Initiative, sagte Scientific American.

Franks sagte, der Gesetzgeber tue zu wenig und zu spät.

„Wir können immer noch versuchen, die drohende Katastrophe abzumildern“, erklärte sie.

Frauen seien „Kanarienvögel im Kohlebergwerk“, sagte Franks und sprach darüber, wie sich KI überproportional auf die weibliche Bevölkerung auswirkt.

Sie fügte hinzu: „Es wird nicht nur das 14-jährige Mädchen oder Taylor Swift sein.“ Es werden Politiker sein. Es werden Weltführer sein. Es werden Wahlen sein.‘

Eine Studie aus dem Jahr 2023 ergab, dass die Erstellung manipulierter Bilder in den letzten fünf Jahren um 550 Prozent gestiegen ist, wobei allein im letzten Jahr 95.820 Deepfake-Videos online gestellt wurden.

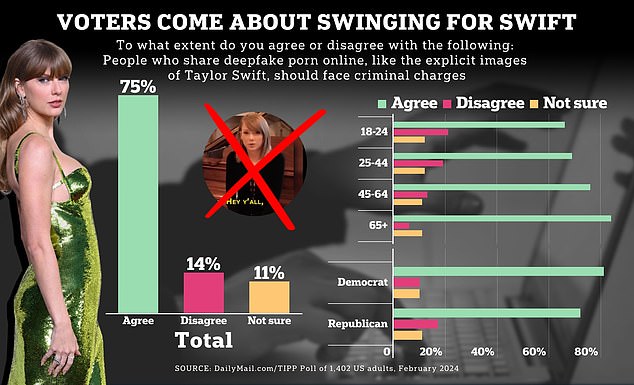

In einer Umfrage von Dailymail.com/TIPP stimmten 75 Prozent der Menschen zu, dass Personen, die gefälschte pornografische Bilder online teilen, strafrechtlich verfolgt werden sollten.

Die Deepfake-Technologie nutzt KI, um das Gesicht oder den Körper einer Person zu manipulieren, und es gibt derzeit keine Bundesgesetze, die Menschen vor der Weitergabe oder Erstellung solcher Bilder schützen.

Der Abgeordnete Joseph Morelle (D-New York), der den Preventing Deepfake of Intimate Images Act vorstellte, forderte andere Gesetzgeber auf, sich zu engagieren und dringend Maßnahmen gegen die zunehmende Verbreitung von Deepfake-Bildern und -Videos zu ergreifen.

Bilder und Videos „können unwiederbringlichen emotionalen, finanziellen und Rufschaden verursachen“, sagte Morelle und fügte hinzu: „Und leider sind Frauen unverhältnismäßig stark betroffen.“

75 Prozent der Menschen stimmen zu, dass Personen, die gefälschte pornografische Bilder online teilen, strafrechtlich verfolgt werden sollten

Doch trotz all ihres Geredes gibt es immer noch keine festgelegten Leitplanken, um die Amerikaner davor zu schützen, Opfer nicht einvernehmlicher Deepfake-Bilder oder -Videos zu werden.

„Es ist klar, dass die KI-Technologie schneller voranschreitet als die notwendigen Leitplanken“, sagte der Kongressabgeordnete Tom Kean Jr., der im November letzten Jahres den AI Labeling Act vorschlug.

Das Gesetz würde KI-Unternehmen dazu verpflichten, alle von KI generierten Inhalte mit Etiketten zu versehen und sie dazu zwingen, verantwortungsvolle Maßnahmen zu ergreifen, um die Veröffentlichung nicht einvernehmlicher Inhalte zu verhindern.

„Ob es sich bei dem Opfer um Taylor Swift oder einen anderen jungen Menschen in unserem Land handelt – wir müssen Schutzmaßnahmen ergreifen, um diesem alarmierenden Trend entgegenzuwirken“, sagte Kean.

Allerdings gibt es bei all dem Gesetzgebungstrudel ein großes Problem: Wer soll wegen eines Verbrechens angeklagt werden, wenn ein Gesetz verabschiedet wird, das Deepfakes unter Strafe stellt?

Laut Amir Ghavi, leitender Berater für KI bei der Anwaltskanzlei Fried Frank, ist es höchst unwahrscheinlich, dass die schuldige Person auftritt und sich identifiziert, und forensische Studien können nicht immer identifizieren und beweisen, welche Software den Inhalt erstellt hat.

Und selbst wenn die Strafverfolgungsbehörden feststellen könnten, woher der Inhalt stammt, könnten sie aufgrund von Abschnitt 230, der besagt, dass Websites nicht für das, was Benutzer posten, verantwortlich sind, daran gehindert werden, Maßnahmen zu ergreifen.

Unabhängig davon bremsen die potenziellen Hindernisse die Politiker nicht aus, nachdem Swift mit sexuell eindeutigen Deepfake-Inhalten in Berührung gekommen ist.

„Niemand – weder Prominente noch normale Amerikaner – sollte jemals in KI-Pornografie zu sehen sein“, sagte Senator Josh Hawley (R-Missouri).

Zum Defiance Act sagte er: „Unschuldige Menschen haben das Recht, ihren Ruf zu verteidigen und die Täter vor Gericht zur Verantwortung zu ziehen.“ Dieser Gesetzentwurf wird dies Wirklichkeit werden lassen.“