Mitglieder des Europäischen Parlaments haben am Donnerstag (13. April) bei einem politischen Treffen mehrere kritische Teile der KI-Verordnung geschlossen, aber die verbotene Verwendung von KI könnte möglicherweise das Haus spalten.

Das KI-Gesetz ist ein wegweisendes Gesetz zur Regulierung der künstlichen Intelligenz auf der Grundlage ihrer Fähigkeit, Schaden zu verursachen, und während sich die Abgeordneten mit einer für den 26. April geplanten wichtigen Ausschussabstimmung einer politischen Einigung über das Dossier nähern, wird die Annahme durch das Plenum eine Herausforderung sein.

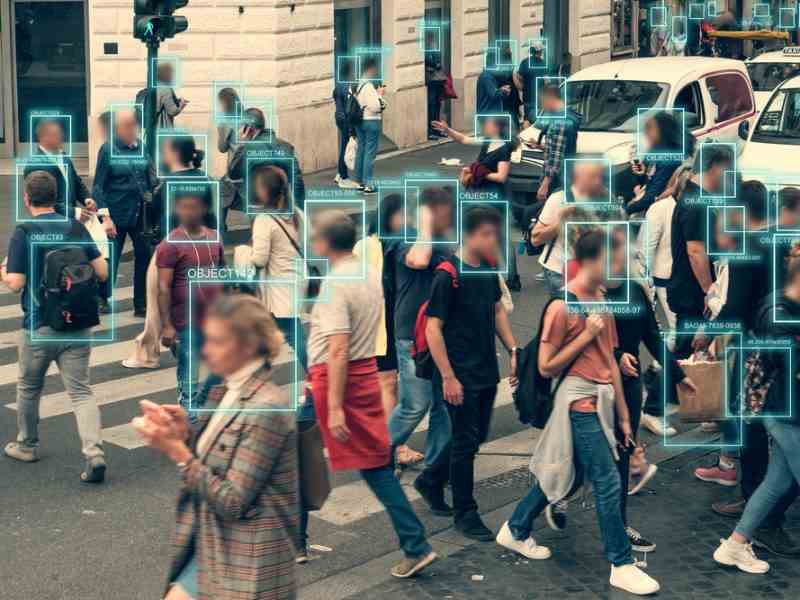

Der politisch heikelste Teil, der während des politischen Treffens mit allen Fraktionen am Donnerstag diskutiert wurde, waren verbotene Praktiken, Anwendungen, die als ein inakzeptables Risiko angesehen werden. Hochrisikokategorisierung, Durchsetzung und Governance sind weitgehend geregelt.

Verbotene Praktiken

Die deutschen Liberalen schlugen vor, eine Bestimmung einzuführen, die „den Einsatz eines KI-Systems zur allgemeinen Überwachung, Erkennung und Interpretation privater Inhalte in zwischenmenschlichen Kommunikationsdiensten verbietet, einschließlich aller Maßnahmen, die die Ende-zu-Ende-Verschlüsselung untergraben würden“.

Der vorgeschlagene Text, der EURACTIV vorliegt, soll jedes KI-gestützte Tool zur Erkennung mutmaßlicher illegaler Inhalte ausschließen, wie es der EU-Vorschlag zur Bekämpfung von Material zum sexuellen Missbrauch von Kindern vorschreibt.

Die Bestimmung stößt jedoch auf Widerstand der konservativen Europäischen Volkspartei (EVP), die eine starke Fraktion hat, die der Strafverfolgung nachsichtig gegenübersteht.

Als Gegenleistung dafür würden progressivere Abgeordnete erreichen, dass Technologien zur Emotionserkennung in Strafverfolgungsbehörden, im Grenzmanagement, am Arbeitsplatz und in Bildungseinrichtungen verboten werden, mit Ausnahme von KI, die für medizinische oder Forschungszwecke verwendet wird, wenn die Probanden zugestimmt haben.

Teil des Abkommens ist auch das Verbot der biometrischen Echtzeitidentifikation, während sie zugelassen wird nachträglich. Obwohl die EVP-Schatten dieser Vereinbarung zustimmen, sind sie sich nicht sicher, ob die Führung der Fraktion keine Schlüsselabstimmung während der Plenarsitzung fordern wird.

Eine Schlüsselabstimmung bedeutet, dass ein alternativer Änderungsantrag eingereicht würde, und wenn dieser nicht durchkommt, müsste die Fraktion gegen den gesamten Text stimmen.

Laut einem Parlamentsbeamten werden politische Diskussionen zwischen den Fraktionsvorsitzenden versuchen, das Szenario zu neutralisieren, in dem die größte Fraktion den Text nicht unterstützt, wodurch die Verhandlungsposition des Parlaments geschwächt wird.

Kategorisierung mit hohem Risiko

Das KI-Gesetz führt eine strenge Regelung für Hochrisikosysteme ein, für die unter Anhang III eine Liste von Bereichen und Anwendungsfällen identifiziert wurde. Obwohl keine Zeit war, Anhang III zu erörtern, wurde diesem Teil weitgehend zugestimmt.

Während im ursprünglichen Vorschlag die Einstufung als hohes Risiko automatisch erfolgen würde, fügten die Abgeordneten die zusätzliche Ebene hinzu, dass die unter Anhang III fallenden KI-Modelle nur dann als hohes Risiko gelten, wenn sie ein erhebliches Risiko für Gesundheits-, Sicherheits- oder Grundrechtsschäden darstellen.

Wenn KI-Anbieter der Ansicht sind, dass von ihrem System kein erhebliches Risiko ausgeht, müssen sie mit einer begründeten Mitteilung die zuständige nationale Behörde oder das EU-KI-Amt informieren, wenn sie in mehreren europäischen Ländern tätig sind.

Die nationale Behörde hätte drei Monate Zeit, um die Einstufung zu hinterfragen, bei einem Widerspruch hätten die KI-Anbieter ein Beschwerderecht. In diesem Zeitraum konnten die KI-Anbieter ihre KI-Lösungen jedoch nach Versand der Notifizierung noch auf dem EU-Markt einführen.

Die entscheidende Frage ist, ob die Behörde auf jede Meldung antworten kann oder muss, mit der von den Grünen forcierten Zwangsmaßnahme, die befürchtet, dass der Rückstand für einige Behörden so erdrückend wäre, dass sie gefährliche Systeme nicht filtern würden.

Gemäß dem Kompromiss wird die Kommission beauftragt, in Absprache mit dem KI-Amt und relevanten Interessengruppen Leitlinien zu entwickeln, die die Kriterien festlegen, anhand derer Unternehmen eine solche Selbstbewertung sechs Monate vor Inkrafttreten der Verordnung durchführen sollten.

Die Sicherheitskomponenten für Verkehrs- oder digitale Netze, die von sektoralen Rechtsvorschriften erfasst werden, wurden aus Anhang III ausgenommen.

Im Bildungsbereich wurden KI-Anwendungen zur Beurteilung des angemessenen Bildungsniveaus oder zur Erkennung von Betrug bei Prüfungen in die Hochrisikoliste aufgenommen.

Für KI am Arbeitsplatz legt Anhang III nun KI-Systeme fest, die für die Anwerbung von Personen bestimmt sind, insbesondere für das Schalten gezielter Stellenanzeigen, das Filtern von Bewerbungen und das Bewerten von Bewerbern.

Governance und Durchsetzung

Der Ko-Berichterstatter, Dragoș Tudorache, drängte zunächst darauf, die Durchsetzung über ein KI-Büro zu zentralisieren, eine neue EU-Einrichtung, die etwas hinter einer Agentur zurückbleibt.

Die Rolle des KI-Büros wurde jedoch aufgrund von Haushaltszwängen erheblich auf eine unterstützende Rolle reduziert, obwohl es sein eigenes Sekretariat und seinen eigenen Exekutivdirektor behielt.

Die Ermittlungsbefugnisse wurden in erster Linie wieder in die Hände der nationalen Behörden gelegt. Die Europäische Kommission soll nur in den schwersten Fällen eingreifen, nämlich überprüfen, wenn eine nationale Behörde ein System untersagt, das trotz Einhaltung der KI-Verordnung ernsthafte Risiken birgt.

In Fällen, die zwei oder mehr Mitgliedstaaten betreffen, ist die zuständige Behörde dort, wo der Verstoß stattgefunden hat. Allerdings sind gemeinsame Ermittlungen vorgesehen, wenn der Verstoß weit verbreitet ist oder 45 Millionen Menschen in mindestens zwei Ländern betrifft.

Weit verbreiteter Verstoß betrifft mindestens drei EU-Länder. Sie kann eine europäische Dimension erlangen, wenn sie die kollektiven Interessen von mindestens zwei Dritteln der EU-Länder oder -Bevölkerung berührt.

Was ist übrig

Neben Anhang III muss der Gesetzgeber noch die Regelungen zu General Purpose AI, KI-Wertschöpfungsketten, eigenständigen Artikeln, Nutzerpflichten und der Präambel der Verordnung finalisieren. Daher kann es bei der Ausschussabstimmung am 26. April noch zu Verzögerungen kommen.

[Edited by Alice Taylor]