Deepfake-KI hat das Potenzial, die nationale Sicherheit zu untergraben, warnte ein Cybersicherheitsexperte.

Dr. Tim Stevens, Direktor der Cyber Security Research Group am King’s College London, sagte, Deepfake-KI – die hyperrealistische Bilder und Videos von Menschen erstellen kann – habe das Potenzial, demokratische Institutionen und die nationale Sicherheit zu untergraben.

Dr. Stevens sagte, die weit verbreitete Verfügbarkeit dieser Instrumente könne von Staaten wie Russland ausgenutzt werden, um Zielbevölkerungen zu „trollen“, um außenpolitische Ziele zu erreichen und die nationale Sicherheit von Ländern zu „untergraben“.

Er fügte hinzu: „KIs und Deepfakes haben das Potenzial, die nationale Sicherheit zu beeinträchtigen.

„Nicht auf dem hohen Niveau der Verteidigung und der zwischenstaatlichen Kriegsführung, sondern bei der allgemeinen Untergrabung des Vertrauens in demokratische Institutionen und die Medien.

“Sie könnten von Autokratien wie Russland ausgenutzt werden, um das Vertrauen in diese Institutionen und Organisationen zu verringern.”

Hier hat MailOnline einen Deepfake-Test sowie alles Wissenswerte über Deepfakes zusammengestellt. Was sind Sie? Wie arbeiten Sie? Welche Risiken bergen sie? Können Sie den Unterschied zwischen der Realität und der KI erkennen?

Was ist ein Deepfake und wie werden sie hergestellt?

Wenn Sie gesehen haben, wie Tom Cruise auf TikTok Gitarre spielte, Barack Obama Donald Trump einen „totalen und kompletten Schwachkopf“ nannte oder Mark Zuckerberg damit prahlte, die Kontrolle über „Milliarden gestohlener Daten von Menschen“ zu haben, haben Sie wahrscheinlich schon einmal einen Deepfake gesehen.

Ein „Deepfake“ ist eine Form der künstlichen Intelligenz, die „tiefes Lernen“ verwendet, um Audio, Bilder und Videos zu manipulieren und hyperrealistische Medieninhalte zu erstellen.

Der Begriff „Deepfake“ wurde 2017 geprägt, als ein Reddit-Nutzer manipulierte Pornovideos im Forum postete. Die Videos tauschten die Gesichter von Prominenten wie Gal Gadot, Taylor Swift und Scarlett Johansson gegen Pornostars aus.

Ein Deepfake verwendet eine Teilmenge der künstlichen Intelligenz (KI), die als Deep Learning bezeichnet wird, um die manipulierten Medien zu konstruieren. Die gebräuchlichste Methode verwendet „tiefe neuronale Netze“, „Encoder-Algorithmen“, ein Basisvideo, in das Sie das Gesicht einer anderen Person einfügen möchten, und eine Sammlung der Videos Ihres Ziels.

Die Deep-Learning-KI untersucht die Daten unter verschiedenen Bedingungen und findet gemeinsame Merkmale zwischen beiden Probanden, bevor sie das Gesicht des Ziels auf die Person im Basisvideo abbildet.

Generative Adversarial Networks (GANs) sind eine weitere Möglichkeit, Deepfakes zu erstellen. GANs verwenden zwei Algorithmen für maschinelles Lernen (ML) mit zwei Rollen. Der erste Algorithmus erstellt Fälschungen, der zweite erkennt sie. Der Prozess ist abgeschlossen, wenn das zweite ML-Modell keine Inkonsistenzen finden kann.

Die Genauigkeit von GANs hängt vom Datenvolumen ab. Deshalb sieht man so viele Deepfakes von Politikern, Prominenten und erwachsenen Filmstars, da oft viele Medien dieser Leute zur Verfügung stehen, um den maschinellen Lernalgorithmus zu trainieren.

Erfolge und Misserfolge von Deepfakes

Ein berüchtigtes Beispiel für einen Deepfake oder „Billigfälscher“ war eine grobe Nachahmung von Wolodymyr Selenskyj, der sich in einem Video, das letztes Jahr in den russischen sozialen Medien weit verbreitet wurde, Russland zu ergeben schien.

Der Clip zeigt den ukrainischen Präsidenten, der von seinem Rednerpult aus seine Truppen auffordert, ihre Waffen niederzulegen und sich Putins Invasionstruppen zu fügen.

Versierte Internetnutzer bemerkten sofort die Diskrepanzen zwischen der Farbe von Zelenskys Hals und Gesicht, dem seltsamen Akzent und der Pixelierung um seinen Kopf.

Mounir Ibrahim, der für Truepic arbeitet, ein Unternehmen, das Online-Deepfakes aufspürt, sagte gegenüber Daily Beast: „Die Tatsache, dass es so schlecht gemacht ist, ist ein bisschen ein Kopfkratzer.

“Sie können den Unterschied deutlich sehen – das ist nicht der beste Deepfake, den wir gesehen haben, nicht einmal annähernd.”

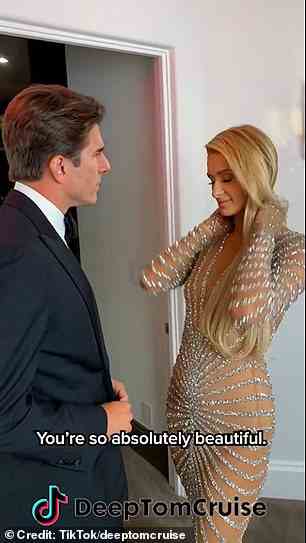

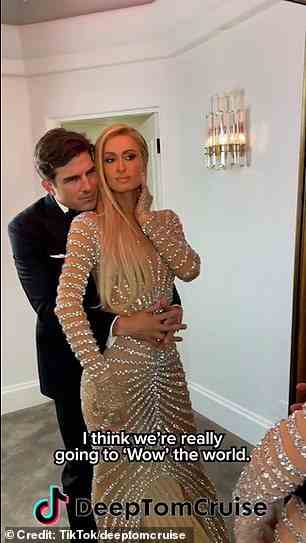

Einer der derzeit überzeugendsten Deepfakes in den sozialen Medien ist der TikTok-Parodie-Account „Deeptomcruise“.

Das Konto wurde im Februar 2021 erstellt und hat über 18,1 Millionen Likes und fünf Millionen Follower.

Es postet hyperrealistische Parodieversionen des Hollywoodstars, der Zaubertricks macht, Golf spielt, sich an die Zeit erinnert, als er den ehemaligen Präsidenten der Sowjetunion traf, und mit Model Paris Hilton posiert.

In einem Clip ist Cruise zu sehen, wie sie Paris Hilton kuschelt, während sie vorgeben, ein Paar zu sein.

Er sagt dem Model: „Du bist so absolut schön“, woraufhin Hilton errötet und sich bei ihm bedankt.

Während er in den Spiegel schaut, sagt Hilton zu dem Schauspieler: „Looking very smart Mr Cruise“.

Der Account postet hyperrealistische Parodieversionen des Hollywoodstars, der Zaubertricks macht, Golf spielt, sich an die Zeit erinnert, als er den ehemaligen Präsidenten der Sowjetunion traf, und mit Model Paris Hilton posiert.

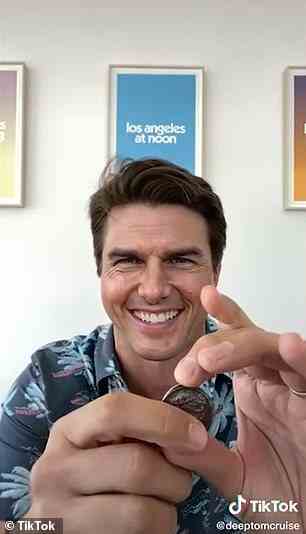

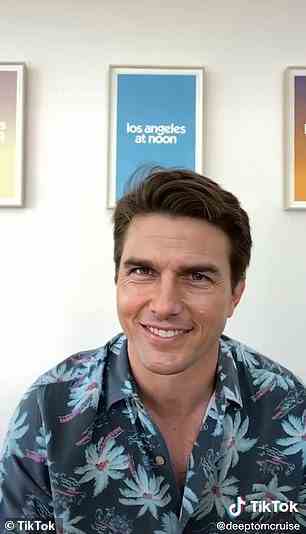

Ein weiteres Video, das mit dem Account geteilt wurde, zeigt Deepfake Cruise, der ein festliches Hawaiihemd trägt, während er vor der Kamera kniet.

Er zeigt eine Münze und lässt sie im Handumdrehen verschwinden – wie von Zauberhand.

„Ich möchte dir etwas Magie zeigen“, sagt der Betrüger und hält die Münze in der Hand.

Das Konto „deeptomcruise“ wurde im Februar 2021 erstellt und hat über 18,1 Millionen Likes und fünf Millionen Follower.

Stellen Deepfakes eine Gefahr dar?

Trotz des Unterhaltungswerts von Deepfakes haben einige Experten vor den Gefahren gewarnt, die sie darstellen könnten.

Der Direktor der Cyber Security Research Group des King’s College London, Dr. Tim Stevens, hat vor der potenziellen Verwendung von Deepfakes zur Verbreitung gefälschter Nachrichten und zur Untergrabung der nationalen Sicherheit gewarnt.

Dr. Stevens sagte, die Technologie könne von Autokratien wie Russland ausgenutzt werden, um Demokratien zu untergraben und die Legitimität für außenpolitische Ziele wie den Krieg zu stärken.

Er sagte, der Zelensky-Deepfake sei „sehr besorgniserregend“, weil es Leute gab, die „es glaubten“, wie es Leute gibt, die „es glauben wollen“.

Theresa Payton, CEO des Cybersicherheitsunternehmens Fortalice, sagte, Deepfake-KI habe auch das Potenzial, echte Daten zu kombinieren, um „Frankenbetrug“ zu schaffen, der Unternehmen infiltrieren und Informationen stehlen könnte.

Sie sagte, das „Zeitalter der zunehmenden Fernarbeit“ sei das perfekte Umfeld für diese Art von „KI-Leuten“, um zu gedeihen.

Miss Payton sagte der Sun: „Während Unternehmen ihre Prozesse zum Scannen von Lebensläufen automatisieren und Ferninterviews durchführen, werden Betrüger und Betrüger modernste Deepfake-KI-Technologie nutzen, um „Klone“ von Arbeitnehmern zu erstellen, die mit synthetischen Identitäten gesichert sind.

“Der digitale Spaziergang in die Identität einer natürlichen Person wird nahezu unmöglich abzuschrecken, zu erkennen und wiederherzustellen sein.”

Dr. Stevens fügte hinzu: „Welche Art von Gesellschaft wollen wir? Wie soll der Einsatz von KI aussehen? Denn im Moment sind die Bremsen gelöst und wir fahren in eine Lücke, die ziemlich unordentlich ist.

„Wenn es jetzt schlecht aussieht, wird es in Zukunft noch schlimmer. Wir brauchen ein Gespräch darüber, wofür diese Werkzeuge sind und wofür sie sein könnten, sowie darüber, wie unsere Gesellschaft für den Rest des 21. Jahrhunderts aussehen wird.

„Das geht nicht weg. Sie sind sehr mächtige Werkzeuge und sie können zum Guten oder zum Bösen eingesetzt werden.’

Die Antworten: Die echten Menschen werden hervorgehoben