Tag: DALLE

Der Download: Chinas Chiplets und das DALL-E 3-Wasserzeichen von OpenAI

Dies ist die heutige Ausgabe von The Download, Unser Wochentags-Newsletter, der täglich über aktuelle Entwicklungen in der Welt der Technologie informiert.

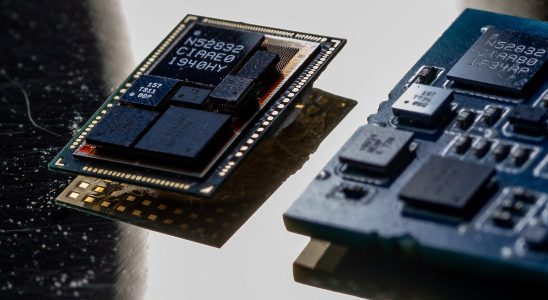

Warum China stark auf Chiplets setzt

Seit einigen Jahren haben die US-Sanktionen die chinesische Halbleiterindustrie im Würgegriff. Chinesische Unternehmen können immer noch Chips für heutige Zwecke herstellen, dürfen jedoch bestimmte Chipherstellungstechnologien nicht importieren, was es ihnen nahezu unmöglich macht, fortschrittlichere Produkte herzustellen.

Es gibt jedoch einen Workaround. Eine als Chiplets bekannte Technologie bietet China nun eine Möglichkeit, … Read more

„Hard Fork“: The People vs. Meta + Marques Brownlee auf YouTube und Future Tech + DALL-E 3 kommt

Dutzende Staaten verklagen Meta, wir holen uns Rat von einem professionellen YouTuber und wir untersuchen beeindruckende Fortschritte bei Bildgeneratoren mit künstlicher Intelligenz.

source site

DALL-E 3-Bildgenerator jetzt in ChatGPT Plus verfügbar

OpenAI gab bekannt, dass es den Zugriff auf seinen neuesten Text-zu-Bild-Generator, DALL-E 3, erweitert, indem es ChatGPT Plus- und Enterprise-Kunden die Nutzung des KI-Systems innerhalb der ChatGPT-App ermöglicht.

DALL-E 3 AI-Bildgenerator

DALL-E 3, das letzten Monat erstmals vorgestellt wurde, nutzt die Funktionen zur Verarbeitung natürlicher Sprache von ChatGPT, um Bilder aus detaillierten Textaufforderungen der Benutzer zu erstellen.

Das neue System zielt darauf ab, das bisherige DALL-E 2-Modell von OpenAI durch verbesserte visuelle Details, schärfere Bilder und Reaktionsfähigkeit auf ausführliche Eingabeaufforderungsbeschreibungen

Jetzt mit DALL-E 3 AI Image Generator

Microsoft hat die Einführung von DALL-E 3, dem neuesten Text-zu-Bild-Modell des KI-Labors OpenAI, für alle Bing-Benutzer angekündigt.

Das fortschrittlichere KI-System ist jetzt kostenlos in Bing Chat und Bing Image Creator verfügbar.

DALL-E 3 baut auf früheren DALL-E-Modellen auf und generiert Bilder aus Textaufforderungen, die Microsoft als realistischer und kreativer beschreibt.

Microsoft gibt an, dass das neue System „Verbesserungen liefert, die die Gesamtqualität und Detailgenauigkeit von Bildern verbessern, zusammen mit einer höheren Genauigkeit für menschliche Hände, Gesichter und Text“.

Leistungsmerkmale von

Benutzer von Bing Chat können jetzt auf den KI-Bildgenerator von DALL-E 3 zugreifen

Der Bildgenerator im KI-gestützten Bing Chat erhält heute ein großes Upgrade: Microsoft gab bekannt, dass das neueste DALL-E 3-Modell von OpenAI jetzt für alle Benutzer von Bing Chat und Bing Image Creator verfügbar ist. Es wurde in der letzten Woche oder so eingeführt, zunächst für Bing Enterprise-Benutzer und dann für Bing Image Creator, aber jetzt ist es für alle zugänglich.

Bing erhält DALL-E 3-Zugriff, noch bevor OpenAIs eigenes ChatGPT dies erhält – dies ist für diesen Monat geplant, jedoch nur

DALL·E 3 kommt zu ChatGPT, Bing und Microsoft Designer

OpenAI hat kürzlich Details zu DALL·E 3 bekannt gegeben, der neuesten Version des Text-zu-Bild-KI-Systems, die diesen Herbst auf ChatGPT Plus, ChatGPT Enterprise, Bings AI Image Creator und Microsoft Designer verfügbar sein wird.

Dieses Update verspricht eine verbesserte Bildgenauigkeit, größere Nuancen und Aufmerksamkeit für den vom Benutzer eingegebenen Text.

Was ist neu bei DALL·E 3?

Bei früheren Iterationen von DALL·E mussten Benutzer ihre Eingabeaufforderungen durch einen Prozess namens „Prompt Engineering“ verfeinern.

DALL·E 3 zielt darauf ab, diesen Aufwand zu beseitigen, indem

Text-zu-Bild-KI wie DALL-E und Midjourney erstellen in Sekundenschnelle detaillierte Bilder mit einer vom Benutzer generierten Eingabeaufforderung

Mit KI-Technologie können im Handumdrehen Kunstwerke erstellt werden. Ob es darum geht, einen Aufsatz zu schreiben, ein Video zu erstellen oder eine Zeichnung zu erstellen: Wenn Sie etwas denken können, kann KI es wahrscheinlich erstellen.

Text-zu-Bild-Generatoren sind eine sich weiterentwickelnde Form der KI, die Bilder auf der Grundlage einiger von Benutzern eingegebener Wörter erstellen kann. Abhängig von der verwendeten Software können Bilder äußerst detailliert und komplex werden.

Es gibt verschiedene Softwareprogramme, die diese Art von Technologie enthalten, einige kostenlos, andere

Das neue Shap-E-Tool von OpenAI ist Dall-E für 3D-Objekte

Das neueste Projekt von OpenAI, Shap-E, ist ein Modell, mit dem Sie 3D-Objekte aus Text generieren können, ähnlich wie Dall-E 2D-Bilder erstellen kann.

Laut OpenAI ist Shap-E „ein bedingtes generatives Modell für 3D-Assets. Im Gegensatz zu jüngsten Arbeiten an generativen 3D-Modellen, die eine einzige Ausgabedarstellung erzeugen, generiert Shap-E direkt die Parameter impliziter Funktionen, die sowohl als texturierte Netze als auch als neuronale Strahlungsfelder gerendert werden können.“

Der GitHub-Beitrag des Unternehmens erklärt weiter, wie Shap-E auf einer Kombination aus Mapping von

Sam Altman: Das habe ich von DALL-E 2 gelernt

Ich denke, es gibt eine Reihe wichtiger Lektionen für uns, wie das nächste Jahrzehnt für die KI aussehen wird. Der erste ist, woher es kam: ein Team von drei Leuten, die an einer Idee in einer zufälligen Ecke des OpenAI-Gebäudes herumstochern.

Diese eine einzige Idee über Diffusionsmodelle, nur ein kleiner Durchbruch bei Algorithmen, hat uns von etwas, das nicht sehr gut ist, zu etwas gebracht, das einen großen Einfluss auf die Welt haben kann.

Eine andere interessante Sache ist, dass

Generative KI verändert alles. Aber was bleibt, wenn der Hype vorbei ist?

Der große Durchbruch hinter den neuen Modellen liegt in der Art und Weise, wie Bilder generiert werden. Die erste Version von DALL-E verwendete eine Erweiterung der Technologie hinter dem Sprachmodell GPT-3 von OpenAI und erzeugte Bilder, indem sie das nächste Pixel in einem Bild vorhersagten, als wären es Wörter in einem Satz. Das funktionierte, aber nicht gut. „Es war keine magische Erfahrung“, sagt Altman. „Erstaunlich, dass es überhaupt funktioniert hat.“

Stattdessen verwendet DALL-E 2 ein sogenanntes Diffusionsmodell. Diffusionsmodelle sind neuronale