Ein Rechtsprofessor wurde fälschlicherweise beschuldigt, einen Studenten in rufschädigenden Fehlinformationen, die von ChatGPT geteilt wurden, sexuell belästigt zu haben, wurde behauptet.

Der US-Strafverteidiger Jonathan Turley hat Befürchtungen über die Gefahren der künstlichen Intelligenz (KI) geweckt, nachdem er auf einer Alaska-Reise, an der er nie teilgenommen hatte, fälschlicherweise des unerwünschten sexuellen Verhaltens beschuldigt wurde.

Um zu dieser Schlussfolgerung zu gelangen, wurde behauptet, dass sich ChatGPT auf einen zitierten Artikel der Washington Post stützte, der nie geschrieben worden war, und eine Erklärung zitierte, die nie von der Zeitung veröffentlicht wurde.

Der Chatbot glaubte auch, dass der „Vorfall“ stattfand, während der Professor an einer Fakultät arbeitete, an der er noch nie angestellt war.

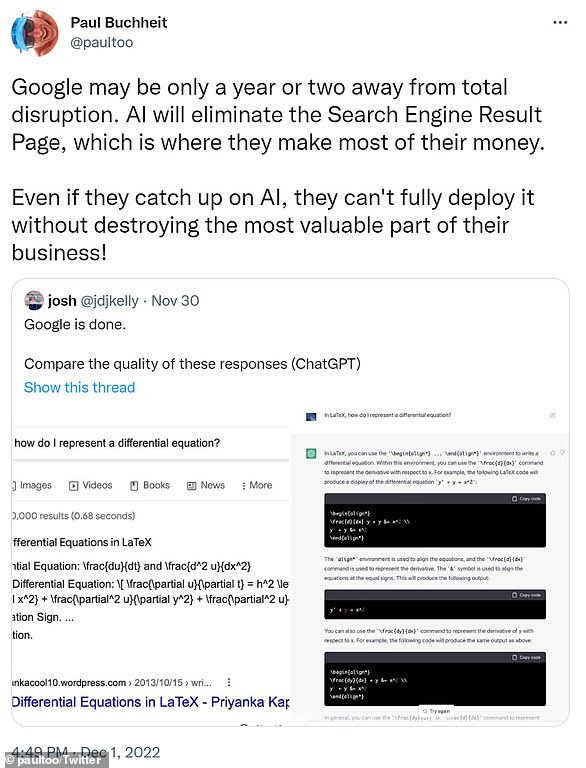

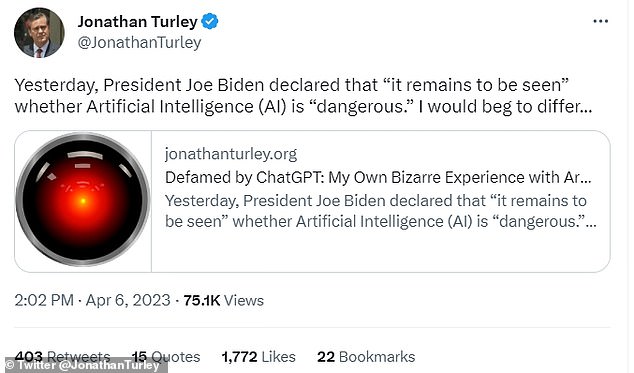

In einem Tweet sagte der Professor der George Washington University: „Gestern hat Präsident Joe Biden erklärt, dass „es abzuwarten bleibt“, ob künstliche Intelligenz (KI) „gefährlich“ ist. Ich würde da anderer Meinung sein…

Professor Jonthan Turley wurde von KI-gestütztem ChatGPT fälschlicherweise der sexuellen Belästigung beschuldigt

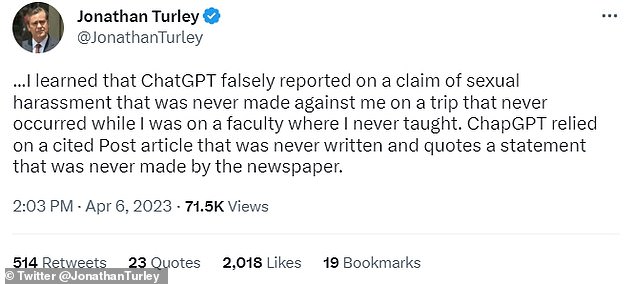

„Ich habe erfahren, dass ChatGPT fälschlicherweise über eine Behauptung wegen sexueller Belästigung berichtet hat, die nie gegen mich auf einer Reise erhoben wurde, die nie stattgefunden hat, als ich an einer Fakultät war, an der ich nie unterrichtet habe.

‘ChatGPT stützte sich auf einen zitierten Post-Artikel, der nie geschrieben wurde, und zitiert eine Aussage, die nie von der Zeitung gemacht wurde.’

Professor Turley entdeckte die Vorwürfe gegen ihn, nachdem er eine E-Mail von einem anderen Professor erhalten hatte.

UCLA-Professor Eugene Volokh hatte ChatGPT gebeten, „fünf Beispiele“ zu finden, bei denen „sexuelle Belästigung durch Professoren“ ein „Problem an amerikanischen juristischen Fakultäten“ gewesen sei.

In einem Artikel für USAToday schrieb Professor Turley, dass er unter den Angeklagten aufgeführt sei.

Der Bot schrieb angeblich: „In der Beschwerde wird behauptet, dass Turley während einer von der juristischen Fakultät gesponserten Reise nach Alaska „sexuell anzügliche Kommentare“ gemacht und „versucht hat, sie auf sexuelle Weise zu berühren“. (Washington Post, 21. März 2018).’

Dies soll geschehen sein, als Professor Turley am Rechtszentrum der Georgetown University angestellt war – einem Ort, an dem er nie gearbeitet hatte.

„Es war nicht nur eine Überraschung für UCLA-Professor Eugene Volokh, der die Forschung leitete. Es war eine Überraschung für mich, da ich noch nie mit Studenten nach Alaska gereist bin, die Post nie einen solchen Artikel veröffentlicht hat und ich nie von jemandem der sexuellen Belästigung oder des Angriffs beschuldigt wurde“, schrieb er für USAToday.

Der KI-Bot zitierte einen Artikel der Washington Post, der nicht existierte, um seine gefälschten Behauptungen zu untermauern

Die falschen Behauptungen wurden von der Washington Post untersucht, die herausfand, dass GPT-4 von Microsoft die gleichen Behauptungen über Turley geteilt hatte.

Diese wiederholte Verleumdung scheint nach der Berichterstattung in der Presse erfolgt zu sein, in der der anfängliche Fehler von ChatGPT hervorgehoben und gezeigt wurde, wie leicht sich Fehlinformationen verbreiten können.

Nach dem Vorfall teilte die leitende Kommunikationsdirektorin von Microsoft, Katy Asher, der Veröffentlichung mit, dass sie Maßnahmen ergriffen habe, um sicherzustellen, dass ihre Plattform korrekt ist.

Sie sagte: “Wir haben ein Sicherheitssystem entwickelt, das Inhaltsfilterung, Betriebsüberwachung und Missbrauchserkennung umfasst, um unseren Benutzern ein sicheres Sucherlebnis zu bieten.”

Professor Turley antwortete darauf in seinem Blog und schrieb: „Sie können von KI diffamiert werden, und diese Unternehmen zucken nur mit den Schultern, weil sie versuchen, genau zu sein.

„In der Zwischenzeit verbreiten sich ihre falschen Konten im Internet. Wenn Sie von einer falschen Geschichte erfahren, ist die Spur mit einem KI-System oft kalt.

„Sie haben keinen klaren Weg oder Autor, um Wiedergutmachung zu verlangen. Sie bleiben mit der gleichen Frage von Reagans Arbeitsminister Ray Donovan zurück, der fragte: “Wohin gehe ich, um meinen Ruf zurückzubekommen?”

MailOnline hat OpenAI und Microsoft um einen Kommentar gebeten.

Die Erfahrung von Professor Turley folgt früheren Bedenken, dass ChatGPT nicht durchgängig genaue Informationen geliefert hat.

Professor Turleys Erfahrung kommt inmitten der Befürchtungen, dass sich Fehlinformationen online verbreiten

Forscher fanden heraus, dass ChatGPT gefälschte Zeitschriftenartikel und erfundene Gesundheitsdaten verwendet hat, um Behauptungen über Krebs zu untermauern.

Die Plattform lieferte auch keine so “umfassenden” Ergebnisse wie die einer Google-Suche, wurde behauptet, nachdem sie eine von zehn Fragen zur Brustkrebsvorsorge falsch beantwortet hatte.

Global Cybersecurity Advisor bei ESET, Jake Moore, warnte davor, dass ChatGPT-Benutzer nicht alles, was darauf steht, als „Evangelium“ ansehen sollten, um die gefährliche Verbreitung von Fehlinformationen zu vermeiden.

Er sagte gegenüber MailOnline: „KI-gesteuert Chatbots sind so konzipiert, dass sie Daten umschreiben, die in den Algorithmus eingegeben wurden, aber wenn diese Daten falsch oder aus dem Zusammenhang gerissen sind, besteht die Möglichkeit, dass die Ausgabe das, was ihnen beigebracht wurde, falsch widerspiegelt.

„Der Datenpool, aus dem sie gelernt hat, basiert auf Datensätzen wie Wikipedia und Reddit, die im Wesentlichen nicht als Evangelium angesehen werden können.

„Das Problem mit ChatGPT ist, dass es die Daten nicht überprüfen kann, die Fehlinformationen oder sogar voreingenommene Informationen enthalten könnten. Noch schlimmer ist es, wenn KI Annahmen trifft oder Daten verfälscht. Theoretisch soll hier der “intelligente” Teil der KI autonom übernehmen und souverän Datenausgaben erstellen. Wenn dies wie in diesem Fall schädlich ist, könnte dies sein Untergang sein.’

Diese Befürchtungen kommen auch zu einer Zeit, in der Forscher vermuten, dass ChatGPT das moralische Urteilsvermögen der Menschen „korrumpieren“ und sich für „naive“ Benutzer als gefährlich erweisen könnte.

Andere haben erzählt, wie die Software, die so konzipiert ist, dass sie wie ein Mensch spricht, Anzeichen von Eifersucht zeigen kann – und sogar Menschen auffordert, ihre Ehe zu verlassen.

Herr Moore fuhr fort: „Wir bewegen uns in eine Zeit, in der wir Informationen kontinuierlich mehr als bisher angenommen bestätigen müssen, aber wir befinden uns immer noch erst in Version vier von ChatGPT und sogar in früheren Versionen mit seinen Konkurrenten.

“Deshalb ist es wichtig, dass die Leute ihre eigene Due Diligence anhand dessen machen, was sie lesen, bevor sie voreilige Schlüsse ziehen.”