ChatGPT, der revolutionäre Chatbot mit künstlicher Intelligenz (KI), wird bald viel mehr können, als menschenähnliche Textnachrichten zu versenden.

Ein Microsoft-Manager hat enthüllt, dass die nächste Version, die diese Woche veröffentlicht werden soll, in der Lage sein wird, Textaufforderungen in einzigartige Videos umzuwandeln.

Der Technologieriese hat stark in ChatGPT investiert und bereits eine Vielzahl neuer Produkte vorgestellt, die es als KI-Assistent integrieren, wie die Suchmaschine Bing.

Aber diese aktualisierte Version mit dem Namen GPT-4, die am Donnerstag auf den Markt kommen soll, wird laut Microsoft Deutschland CTO Andreas Braun „multimodale Modelle“ haben.

Das bedeutet, dass Inhalte in mehreren Formaten wie Audioclips, Bilder und Videoclips aus einer Texteingabe generiert werden können.

Ein Microsoft-Manager hat bekannt gegeben, dass die nächste Version von ChatGPT in der Lage sein wird, Textaufforderungen in einzigartige Videos umzuwandeln, und diese Woche veröffentlicht wird

ChatGPT ist ein großes Sprachmodell, das mit einer riesigen Menge an Textdaten trainiert wurde, sodass es menschenähnliche Textantworten auf eine bestimmte Eingabeaufforderung generieren kann.

Die aktuelle Version, die im November vom Start-up OpenAI veröffentlicht wurde, ist als GPT3.5 bekannt und hat eine große Bandbreite an Fähigkeiten.

Zum Beispiel wurde es verwendet, um Prüfungen zu bestehen, eine Predigt zu halten, Software zu schreiben und Beziehungsratschläge zu geben.

Es beschränkte sich darauf, Antworten als Text bereitzustellen, aber Herr Braun gab bekannt, dass sich dies bei der Veranstaltung „AI in Focus – Digital Kickoff“ am vergangenen Donnerstag ändern wird.

„Wir werden GPT-4 nächste Woche vorstellen, da werden wir multimodale Modelle haben, die ganz andere Möglichkeiten bieten werden – zum Beispiel Videos“, so Heise.

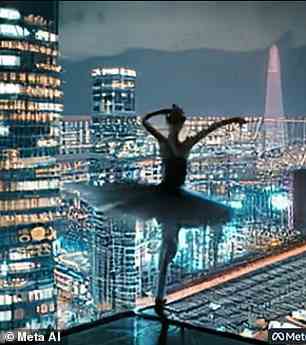

Dies ist kein völlig bahnbrechendes Konzept – im September stellte der konkurrierende Technologieriese Meta sein eigenes KI-System vor, das Videos aus Texteingabeaufforderungen generiert.

„Make-A-Video“ wurde mit Bildern mit Untertiteln trainiert, um mehr über die Welt und ihre Beschreibung zu erfahren, und mit unbeschrifteten Videos, um festzustellen, wie sich die Welt bewegt.

Die resultierenden Clips sind zwar beeindruckend, aber tendenziell verschwommen und ohne Ton.

Make-A-Video muss der Öffentlichkeit noch zugänglich gemacht werden, aber die Veröffentlichung von GPT-4.0 hat das Potenzial, dies zu ändern.

Experten haben gesagt, dass der Erfolg der Zusammenarbeit von ChatGPT und OpenAI mit Microsoft Google dazu veranlasst hat, seinen eigenen KI-Chatbot Bard zu veröffentlichen.

Die Spekulationen begannen, als Bard in einem Werbevideo eine Frage falsch beantwortete – wodurch 100 Milliarden Pfund vom Wert seiner Firma abgewischt wurden.

Im September stellte der konkurrierende Technologieriese Meta sein eigenes KI-System vor, das Videos aus Texteingabeaufforderungen generiert. „Make-A-Video“ wurde mit Bildern mit Untertiteln trainiert, um mehr über die Welt und ihre Beschreibung zu erfahren, und mit unbeschrifteten Videos, um festzustellen, wie sich die Welt bewegt

Während GPT-4 der erste Ausflug von OpenAI in die Videogenerierung sein wird, hat es bereits eine Text-zu-Bild-KI, DALL-E, entwickelt.

Im Jahr 2020 kündigte das Unternehmen auch Jukebox an, ein Tool, das Musik aus einer Eingabeaufforderung heraus erstellt und den Stil verschiedener Künstler nachahmen kann.

Ohne diese Tools ausdrücklich zu erwähnen, sagte Herr Braun, dass das neue ChatGPT „die Modelle umfassend machen“ werde.

Bei der „AI in Focus“-Veranstaltung, die an Microsoft-Partner und potenzielle Kunden ausgestrahlt wurde, verriet Herr Braun nicht, ob GPT-4 eigenständig oder als Teil eines Produkts veröffentlicht wird.

Das Technologieunternehmen hat für Donnerstag eine Veranstaltung geplant, bei der „die Zukunft der KI“ vorgestellt werden soll, die möglicherweise weitere Informationen liefert.

Seit 2021 kursieren Gerüchte darüber, wie dieses Update aussehen wird, wobei Wired spekuliert, dass es 100 Billionen Parameter verwenden wird.

Diese geben ihm in einem bestimmten Kontext viel mehr Optionen für „nächstes Wort“ oder „nächsten Satz“ als derzeit, wodurch es menschlicher wird.

Dies wurde jedoch von Sam Altman, CEO von OpenAI, eingestellt, der StrictlyVC sagte, es sei „total bulls**t“.

Andere haben gesagt, dass GPT-4 besser darin sein wird, Computercode zu generieren, längere Texteingabeaufforderungen zu verarbeiten und in der Lage sein wird, Text, Bilder, Töne und Videos auszugeben.

Herr Altman sagte dem Podcast „AI for the Next Era“: „Ich denke, wir werden nicht mehr lange multimodale Modelle bekommen, und das wird neue Dinge eröffnen.“

OpenAI-CEO Sam Altman (im Bild) sagte im Podcast „AI for the Next Era“: „Ich denke, wir werden in nicht allzu langer Zeit multimodale Modelle bekommen, und das wird neue Dinge eröffnen.“

Während eine umfassende, multimodale KI ein neues Konzept ist, gibt es seit Jahren Diskussionen über die Auswirkungen der KI-Videogenerierung, insbesondere im Hinblick auf „Deepfakes“.

Dies sind Formen der KI, die „Deep Learning“ verwenden, um Audio, Bilder oder Videos zu manipulieren und hyperrealistische, aber gefälschte Medieninhalte zu erstellen.

Der Begriff wurde 2017 geprägt, als ein Reddit-Nutzer manipulierte Pornovideos im Forum postete.

Die Videos tauschten die Gesichter von Prominenten wie Gal Gadot, Taylor Swift und Scarlett Johansson gegen Pornostars aus.

Ein weiteres berüchtigtes Beispiel für einen Deepfake oder „Billigfälscher“ war eine grobe Nachahmung von Wolodymyr Selenskyj, der sich in einem Video, das letztes Jahr in den russischen sozialen Medien weit verbreitet wurde, Russland zu ergeben schien.

Der Clip zeigt den ukrainischen Präsidenten, der von seinem Rednerpult aus seine Truppen auffordert, ihre Waffen niederzulegen und sich Putins Invasionstruppen zu fügen.

Versierte Internetnutzer bemerkten sofort die Diskrepanzen zwischen der Farbe von Zelenskys Hals und Gesicht, dem seltsamen Akzent und der Pixelierung um seinen Kopf.

Trotz des Unterhaltungswerts von Deepfakes haben einige Experten vor den Gefahren gewarnt, die sie darstellen könnten.

Dr. Tim Stevens, Direktor der Cyber Security Research Group am King’s College London, sagte, Deepfake-KI habe das Potenzial, demokratische Institutionen und die nationale Sicherheit zu untergraben.

Er sagte, die weit verbreitete Verfügbarkeit dieser Instrumente könne von Staaten wie Russland ausgenutzt werden, um Zielbevölkerungen zu „trollen“, um außenpolitische Ziele zu erreichen und die nationale Sicherheit von Ländern zu „untergraben“.

Er fügte hinzu: „KIs und Deepfakes haben das Potenzial, die nationale Sicherheit zu beeinträchtigen.

„Nicht auf dem hohen Niveau der Verteidigung und der zwischenstaatlichen Kriegsführung, sondern bei der allgemeinen Untergrabung des Vertrauens in demokratische Institutionen und die Medien.

“Sie könnten von Autokratien wie Russland ausgenutzt werden, um das Vertrauen in diese Institutionen und Organisationen zu verringern.”

Tatsächlich wird prognostiziert, dass bis 2025 90 Prozent der Online-Inhalte mithilfe künstlicher Intelligenz generiert oder erstellt werden.