Apple hat am Donnerstag Änderungen an iPhones vorgestellt, die darauf abzielen, Fälle von sexuellem Missbrauch von Kindern aufzudecken, ein Schritt, der Eltern und der Polizei wahrscheinlich gefallen wird, der aber bereits Datenschutzwächter beunruhigte.

Später in diesem Jahr werden iPhones komplexe Technologien verwenden, um Bilder von sexuellem Missbrauch von Kindern, allgemein als Kinderpornografie bekannt, zu erkennen, die Benutzer auf den iCloud-Speicherdienst von Apple hochladen, teilte das Unternehmen mit. Apple sagte auch, dass Eltern bald eine Funktion aktivieren können, die melden kann, wenn ihre Kinder Nacktfotos in einer Textnachricht senden oder empfangen.

Apple sagte, es habe die neuen Funktionen so entwickelt, dass die Privatsphäre der Benutzer geschützt sei, unter anderem indem sichergestellt wurde, dass Apple niemals Nacktbilder sieht oder herausfindet, die in den Textnachrichten eines Kindes ausgetauscht werden. Das Scannen erfolgt auf dem Gerät des Kindes und die Benachrichtigungen werden nur an die Geräte der Eltern gesendet. Apple lieferte Zitate von einigen Cybersicherheitsexperten und Kindersicherheitsgruppen, die den Ansatz des Unternehmens lobten.

Andere Cybersicherheitsexperten waren immer noch besorgt. Matthew D. Green, Kryptographie-Professor an der Johns Hopkins University, sagte, die neuen Funktionen von Apple hätten einen gefährlichen Präzedenzfall geschaffen, indem sie Überwachungstechnologien entwickelt hätten, die Strafverfolgungsbehörden oder Regierungen ausnutzen könnten.

„Sie haben der Welt Privatsphäre verkauft und die Leute dazu gebracht, ihren Geräten zu vertrauen“, sagte Mr. Green. „Aber jetzt kapitulieren sie im Grunde vor den denkbar schlechtesten Forderungen jeder Regierung. Ich sehe nicht, wie sie von jetzt an nein sagen sollen.“

Apples Schritte folgen einer Untersuchung der New York Times aus dem Jahr 2019, die eine globale kriminelle Unterwelt enthüllte, die fehlerhafte und unzureichende Bemühungen ausnutzte, um die Explosion von Bildern von sexuellem Missbrauch von Kindern einzudämmen. Die Untersuchung ergab, dass viele Technologieunternehmen ihre Plattformen nicht angemessen überwachen konnten und dass die Menge solcher Inhalte drastisch zunahm.

Während das Material älter ist als das Internet, haben Technologien wie Smartphone-Kameras und Cloud-Speicher eine breitere Verbreitung der Bilder ermöglicht. Manche Bilder kursieren seit Jahren, traumatisieren und verfolgen die abgebildeten Menschen weiter.

Aber die gemischten Bewertungen der neuen Funktionen von Apple zeigen den schmalen Grat, den Technologieunternehmen zwischen der Unterstützung der öffentlichen Sicherheit und der Gewährleistung der Privatsphäre der Kunden gehen müssen. Strafverfolgungsbeamte beschweren sich seit Jahren darüber, dass Technologien wie die Smartphone-Verschlüsselung strafrechtliche Ermittlungen lahmgelegt haben, während technische Führungskräfte und Cybersicherheitsexperten argumentiert haben, dass eine solche Verschlüsselung für den Schutz der Daten und der Privatsphäre der Menschen von entscheidender Bedeutung ist.

In der Ankündigung vom Donnerstag versuchte Apple, diese Nadel einzufädeln. Es sagte, es habe einen Weg entwickelt, um Kinderräuber auszurotten, die die iPhone-Sicherheit nicht gefährden.

Um das in iCloud hochgeladene Material zum sexuellen Missbrauch von Kindern oder CSAM zu erkennen, verwenden iPhones eine Technologie namens Image-Hashes, sagte Apple. Die Software reduziert ein Foto auf einen eindeutigen Satz von Zahlen – eine Art Bildfingerabdruck.

Lassen Sie uns Ihnen helfen, Ihr digitales Leben zu schützen

Das iPhone-Betriebssystem wird in Kürze eine Datenbank mit Hashes von bekanntem Material zum sexuellen Missbrauch von Kindern speichern, die von Organisationen wie dem National Center for Missing & Exploited Children bereitgestellt werden, und diese Hashes mit den Hashes jedes Fotos in der iCloud eines Benutzers vergleichen, um zu sehen, ob es dort vorhanden ist ist ein Spiel.

Sobald es eine bestimmte Anzahl von Übereinstimmungen gibt, werden die Fotos einem Apple-Mitarbeiter gezeigt, um sicherzustellen, dass es sich tatsächlich um Bilder von sexuellem Missbrauch von Kindern handelt. In diesem Fall werden sie an das National Center for Missing & Exploited Children weitergeleitet und das iCloud-Konto des Benutzers wird gesperrt.

Apple sagte, dieser Ansatz bedeute, dass Menschen ohne Material über sexuellen Missbrauch von Kindern auf ihren Handys ihre Fotos nicht von Apple oder den Behörden sehen würden.

„Wenn Sie eine Sammlung von CSAM-Material speichern, ja, das ist schlecht für Sie“, sagte Erik Neuenschwander, Datenschutzchef von Apple. “Aber für den Rest von euch ist das nicht anders.”

Das System von Apple scannt keine Videos, die in iCloud hochgeladen wurden, obwohl Täter das Format seit Jahren verwenden. Im Jahr 2019 überstieg die Zahl der an das Nationalzentrum gemeldeten Videos erstmals die der Fotos. Das Zentrum erhält oft mehrere Berichte für denselben Inhalt.

Das US-Gesetz verlangt von Technologieunternehmen, Fälle von sexuellem Missbrauch von Kindern den Behörden anzuzeigen. Apple hat in der Vergangenheit weniger Fälle gemeldet als andere Unternehmen. Im vergangenen Jahr zum Beispiel meldete Apple dem National Center for Missing & Exploited Children 265 Fälle, während Facebook nach den Statistiken des Centers 20,3 Millionen meldete. Diese enorme Lücke ist zum Teil auf die Entscheidung von Apple zurückzuführen, nicht nach solchem Material zu suchen, unter Berufung auf die Privatsphäre seiner Benutzer.

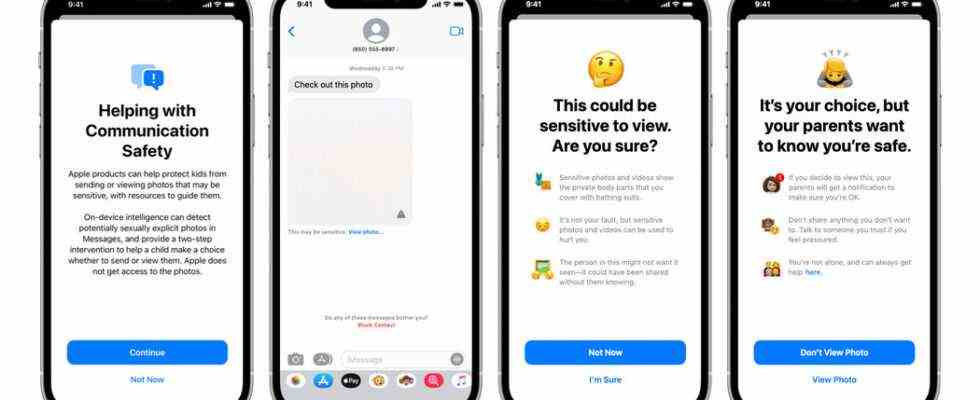

Apples andere Funktion, die Fotos in Textnachrichten scannt, wird nur für Familien mit gemeinsamen Apple iCloud-Konten verfügbar sein. Wenn Eltern es einschalten, analysiert das iPhone ihres Kindes jedes empfangene oder in einer SMS gesendete Foto, um festzustellen, ob es Nacktheit enthält. Nacktfotos, die an ein Kind gesendet werden, werden unscharf dargestellt und das Kind muss entscheiden, ob es es ansehen möchte. Wenn Kinder unter 13 Jahren ein Nacktfoto anzeigen oder senden möchten, werden ihre Eltern benachrichtigt.

Herr Green sagte, er befürchte, dass ein solches System missbraucht werden könnte, weil es den Strafverfolgungsbehörden und Regierungen gezeigt habe, dass Apple jetzt eine Möglichkeit habe, bestimmte Inhalte auf einem Telefon zu kennzeichnen und gleichzeitig die Verschlüsselung beizubehalten. Apple hat den Behörden zuvor argumentiert, dass eine Verschlüsselung den Abruf bestimmter Daten verhindert.

“Was passiert, wenn andere Regierungen Apple bitten, dies für andere Zwecke zu verwenden?” fragte Mr. Green. “Was wird Apple sagen?”

Herr Neuenschwander wies diese Bedenken zurück und sagte, dass Vorkehrungen getroffen wurden, um einen Missbrauch des Systems zu verhindern, und dass Apple solche Forderungen einer Regierung ablehnen würde.

„Wir werden sie darüber informieren, dass wir nicht das gebaut haben, woran sie denken“, sagte er.

Die Times berichtete in diesem Jahr, dass Apple auf Druck der chinesischen Regierung die privaten Daten seiner chinesischen Nutzer in China kompromittiert und Apps im Land proaktiv zensiert habe.

Michael H. Keller und Gabriel JX Tanz Berichterstattung beigetragen.