Fast wöchentlich wird Brian Levine, Informatiker an der University of Massachusetts Amherst, von seiner 14-jährigen Tochter die gleiche Frage gestellt: Kann ich diese App herunterladen?

Herr Levine reagiert, indem er Hunderte von Kundenrezensionen im App Store nach Vorwürfen von Belästigung oder sexuellem Kindesmissbrauch durchsucht. Aufgrund des manuellen und willkürlichen Prozesses fragt er sich, warum nicht mehr Ressourcen zur Verfügung stehen, um Eltern dabei zu helfen, schnelle Entscheidungen über Apps zu treffen.

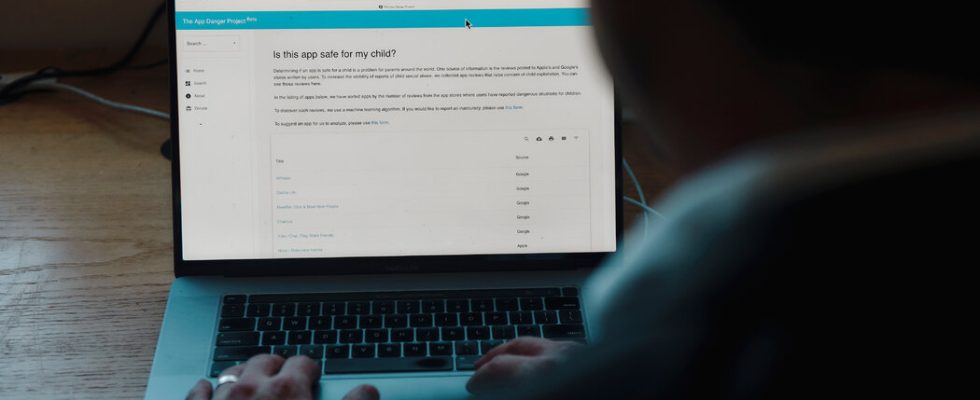

In den letzten zwei Jahren hat Herr Levine versucht, Eltern zu helfen, indem er ein Rechenmodell entwickelt hat, das die Bewertungen von Kunden zu sozialen Apps bewertet. Mithilfe künstlicher Intelligenz zur Auswertung des Kontexts von Bewertungen mit Wörtern wie „Kinderporno“ oder „Pädophilie“ haben er und ein Forscherteam eine durchsuchbare Website namens „App Danger Project“ erstellt, die klare Leitlinien zur Sicherheit von Social-Networking-Apps bietet .

Die Website erfasst Nutzerbewertungen zu Sexualstraftätern und bietet Sicherheitsbewertungen von Apps mit negativen Bewertungen. Darin sind Rezensionen aufgeführt, in denen sexueller Missbrauch erwähnt wird. Obwohl das Team die Gutachter nicht kontaktierte, um deren Behauptungen zu überprüfen, las es jede einzelne und schloss diejenigen aus, die keine Bedenken hinsichtlich der Kindersicherheit hervorhoben.

„Es gibt Bewertungen, in denen es um die Art des auftretenden gefährlichen Verhaltens geht, aber diese Bewertungen werden unterdrückt“, sagte Herr Levine. „Du kannst sie nicht finden.“

Kriminelle nutzen Apps und Online-Dienste zunehmend als Waffe, um anstößige Bilder zu sammeln. Im vergangenen Jahr gingen bei den Strafverfolgungsbehörden 7.000 Meldungen über Kinder und Jugendliche ein, die zum Versenden von Nacktbildern gezwungen und anschließend um Fotos oder Geld erpresst wurden. Das FBI wollte nicht sagen, wie viele dieser Berichte glaubwürdig waren. Die als Sextortion bezeichneten Vorfälle haben sich während der Pandemie mehr als verdoppelt.

Da die App-Stores von Apple und Google keine Stichwortsuche anbieten, könne es für Eltern schwierig sein, Warnungen vor unangemessenem Sexualverhalten zu finden, sagte Levine. Er stellt sich das App Danger Project vor, das kostenlos ist und andere Dienste ergänzt, die die Eignung von Produkten für Kinder überprüfen, wie z. B. Common Sense Media, indem Apps identifiziert werden, die bei der Überwachung von Benutzern nicht genug bewirken. Er hat nicht vor, von der Website zu profitieren, ermutigt aber zu Spenden an die University of Massachusetts, um ihre Kosten auszugleichen.

Herr Levine und ein Dutzend Informatiker untersuchten die Anzahl der Rezensionen, die in mehr als 550 von Apple und Google vertriebenen Social-Networking-Apps vor sexuellem Kindesmissbrauch warnten. Sie fanden heraus, dass ein Fünftel dieser Apps zwei oder mehr Beschwerden über Inhalte zum sexuellen Missbrauch von Kindern enthielt und dass 81 Angebote in den App- und Play-Stores sieben oder mehr dieser Art von Bewertungen hatten.

Ihre Untersuchung baut auf früheren Berichten über Apps mit Beschwerden über unerwünschte sexuelle Interaktionen auf. Im Jahr 2019 erläuterte die New York Times, wie Raubtiere Videospiele und Social-Media-Plattformen als Jagdgründe nutzen. In einem separaten Bericht der Washington Post aus diesem Jahr wurden Tausende von Beschwerden über sechs Apps festgestellt, die dazu führten, dass Apple die Apps Monkey, ChatLive und Chat for Strangers entfernte.

Apple und Google haben ein finanzielles Interesse an der Verbreitung von Apps. Die Technologieriesen, die bis zu 30 Prozent des App-Store-Umsatzes ausmachen, haben im vergangenen Jahr drei Apps mit mehreren Nutzerberichten über sexuellen Missbrauch zu einem Umsatz von 30 Millionen US-Dollar verholfen: Hoop, MeetMe und Whisper, so das Marktforschungsunternehmen Sensor Tower.

In mehr als einem Dutzend Strafsachen hat das Justizministerium diese Apps als Tools beschrieben, mit denen Kinder nach sexuellen Bildern oder Treffen gefragt wurden – Hoop in Minnesota; MeetMe in Kalifornien, Kentucky und Iowa; und Whisper in Illinois, Texas und Ohio.

Herr Levine sagte, Apple und Google sollten Eltern mehr Informationen über die Risiken geben, die von einigen Apps ausgehen, und diejenigen, die bereits Missbrauch begangen haben, besser überwachen.

„Wir sagen nicht, dass jede App, in der es Rezensionen gibt, die besagen, dass sie Kinderschänder enthält, rausgeschmissen werden sollte, aber wenn sie über die Technologie verfügen, dies zu überprüfen, warum sind dann einige dieser problematischen Apps immer noch im Handel?“ fragte Hany Farid, ein Informatiker an der University of California, Berkeley, der mit Herrn Levine am App Danger Project arbeitete.

Apple und Google sagten, dass sie regelmäßig Nutzerbewertungen von Apps mit ihren eigenen Rechenmodellen scannen und Vorwürfe des sexuellen Missbrauchs von Kindern untersuchen. Wenn Apps gegen ihre Richtlinien verstoßen, werden sie entfernt. Apps verfügen über Altersfreigaben, um Eltern und Kindern zu helfen, und Software ermöglicht es Eltern, Downloads zu untersagen. Die Unternehmen bieten App-Entwicklern auch Tools zur Überwachung von sexuellem Material von Kindern an.

Dan Jackson, ein Sprecher von Google, sagte, das Unternehmen habe die vom App Danger Project gelisteten Apps untersucht und keine Hinweise auf Material zum sexuellen Missbrauch von Kindern gefunden.

„Während Benutzerbewertungen eine wichtige Rolle als Signal für weitere Untersuchungen spielen, sind Behauptungen aus Bewertungen allein nicht zuverlässig genug“, sagte er.

Apple untersuchte außerdem die vom App Danger Project aufgelisteten Apps und entfernte 10, die gegen seine Verbreitungsregeln verstießen. Es lehnte es ab, eine Liste dieser Apps oder die Gründe für die Maßnahmen bereitzustellen.

„Unser App-Review-Team arbeitet rund um die Uhr daran, jede neue App und jedes App-Update sorgfältig zu prüfen, um sicherzustellen, dass sie den Apple-Standards entspricht“, sagte ein Sprecher in einer Erklärung.

Das App Danger-Projekt sagte, es habe eine beträchtliche Anzahl von Rezensionen gefunden, die darauf hindeuteten, dass Hoop, eine Social-Networking-App, für Kinder unsicher sei; Beispielsweise wurde festgestellt, dass 176 von 32.000 Bewertungen seit 2019 Berichte über sexuellen Missbrauch enthielten.

„Hier gibt es eine Fülle von Sexualstraftätern, die Menschen mit Links zum Beitritt zu Dating-Seiten zuspammen, sowie Menschen mit dem Namen ‚Lies mein Bild‘“, heißt es in einer Rezension aus dem App Store. „Es zeigt ein Bild eines kleinen Kindes und sagt, man solle auf deren Website nach Kinderpornos suchen.“

Hoop, das unter neuer Leitung steht, verfügt über ein neues Inhaltsmoderationssystem, um die Benutzersicherheit zu erhöhen, sagte Liath Ariche, CEO von Hoop, und fügte hinzu, dass die Forscher beleuchteten, wie die ursprünglichen Gründer Schwierigkeiten hatten, mit Bots und böswilligen Benutzern umzugehen. „Die Situation hat sich drastisch verbessert“, sagte der Vorstandsvorsitzende.

Die Meet Group, zu der MeetMe gehört, sagte, sie toleriere weder den Missbrauch noch die Ausbeutung von Minderjährigen und nutze Tools der künstlichen Intelligenz, um Raubtiere zu erkennen und sie den Strafverfolgungsbehörden zu melden. Es meldet den Behörden unangemessene oder verdächtige Aktivitäten, darunter eine Episode aus dem Jahr 2019, in der ein Mann aus Raleigh, North Carolina, Kinderpornografie anforderte.

Whisper reagierte nicht auf Anfragen nach Kommentaren.

Sergeant. Sean Pierce, der die Task Force des San Jose Police Department für Internetverbrechen gegen Kinder leitet, sagte, einige App-Entwickler hätten es vermieden, Beschwerden über Sextortion zu untersuchen, um ihre rechtliche Haftung zu verringern. Das Gesetz besagt, dass sie kriminelle Aktivitäten nicht melden müssen, es sei denn, sie finden sie, sagte er.

„Es ist eher die Schuld der Apps als des App Stores, denn die Apps sind es, die das machen“, sagte Sergeant Pierce, der im Rahmen eines Programms namens „Vigilant Parent Initiative“ Präsentationen an Schulen in San Jose anbietet. Ein Teil der Herausforderung, sagte er, bestehe darin, dass viele Apps Fremde für anonyme Gespräche miteinander verbinden, was es für die Strafverfolgungsbehörden schwierig mache, dies zu überprüfen.

Apple und Google erstatten der US-amerikanischen Clearingstelle jährlich Hunderte von Meldungen wegen sexuellen Kindesmissbrauchs, geben jedoch nicht an, ob sich diese Meldungen auf Apps beziehen.

Whisper gehört zu den Social-Media-Apps, bei denen das Team von Herrn Levine mehrere Rezensionen gefunden hat, in denen sexuelle Ausbeutung erwähnt wird. Nach dem Herunterladen der App erhielt ein Gymnasiast im Jahr 2018 eine Nachricht von einem Fremden, der anbot, im Austausch für ein Oben-Ohne-Foto einen Beitrag zu einer Spendenaktion für Schulrobotik zu leisten. Nachdem sie ein Bild geschickt hatte, drohte der Fremde, es ihrer Familie zu schicken, sofern sie nicht weitere Bilder zur Verfügung stellte.

Die Familie des Teenagers meldete den Vorfall den örtlichen Strafverfolgungsbehörden, wie aus einem Bericht der Mascoutah Police Department in Illinois hervorgeht, die später einen Einheimischen, Joshua Breckel, festnahm. Er wurde wegen Erpressung und Kinderpornografie zu 35 Jahren Gefängnis verurteilt. Obwohl Whisper nicht für verantwortlich erklärt wurde, wurde sie zusammen mit einem halben Dutzend Apps als die wichtigsten Tools genannt, mit denen er Bilder von Opfern im Alter von 10 bis 15 Jahren sammelte.

Chris Hoell, ein ehemaliger Bundesanwalt im Südbezirk von Illinois, der am Breckel-Fall gearbeitet hat, sagte, die umfassende Bewertung der Bewertungen durch das App Danger Project könne Eltern dabei helfen, ihre Kinder vor Problemen mit Apps wie Whisper zu schützen.

„Das ist wie ein sich aggressiv ausbreitender, behandlungsresistenter Tumor“, sagte Herr Hoell, der jetzt eine Privatpraxis in St. Louis hat. „Wir brauchen mehr Werkzeuge.“